SketchVideo:基于草图的视频生成与编辑框架

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

主要介绍

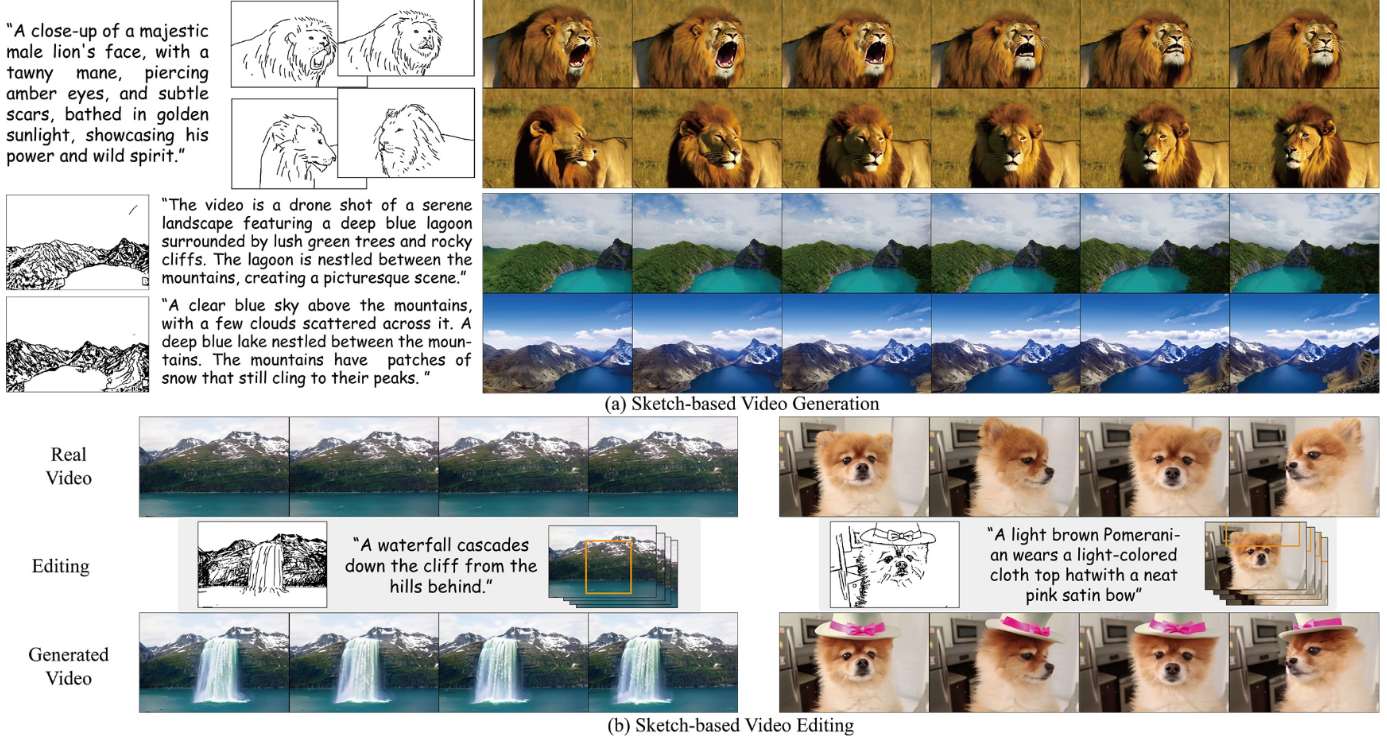

SketchVideo 是由快手联合中国科学院大学、香港科技大学等高校推出的创新框架,旨在通过手绘草图实现视频生成与编辑。该框架结合深度学习与计算机视觉技术,允许用户通过简单草图控制视频内容,降低专业门槛,提升创作效率。

功能特点

- 草图驱动生成:用户绘制关键帧草图,框架自动生成完整视频,支持动态场景与角色动作。

- 时空一致性优化:通过注意力机制确保帧间连贯性,避免画面闪烁或断裂。

- 精细编辑能力:支持对已有视频的局部区域进行草图修改,实现内容替换或特效添加。

- 多模态输入:可结合文本描述、参考图像或视频片段,增强生成结果的语义准确性。

- 低门槛交互:无需专业动画技能,普通用户可通过简单草图快速实现创意。

优缺点

优点:

- 直观交互:草图作为输入方式,符合人类创作习惯,降低技术门槛。

- 灵活编辑:支持对已有视频的局部修改,适用于影视后期、广告制作等场景。

- 高效生成:结合预训练模型与注意力机制,减少计算资源消耗,提升生成速度。

缺点:

- 草图精度要求:过于简略的草图可能导致生成结果偏离预期,需用户具备一定绘图基础。

- 复杂场景限制:对多角色、高动态场景的支持有待优化,生成效果可能不如专业工具。

如何使用

- 准备草图:用户绘制关键帧草图(如角色动作、场景布局)。

- 输入框架:将草图与文本描述(可选)输入SketchVideo系统。

- 生成/编辑:框架生成视频或修改指定区域,支持实时预览与迭代调整。

框架技术原理

- 基于扩散模型:采用视频扩散模型(VDM),通过逐步去噪生成视频帧。

- 草图控制网络:在预训练模型中嵌入可训练的线稿控制模块,预测残差特征,实现草图引导生成。

- 帧间注意力机制:通过稀疏方式传播关键帧控制信号,确保时序一致性。

- 局部融合策略:在隐空间中融合原始视频与编辑结果,保留非编辑区域内容。

优缺点

优点:

- 降低视频创作门槛,支持非专业用户参与。

- 草图输入直观,适合快速原型设计与创意验证。

- 编辑功能灵活,可局部修改视频内容。

缺点:

- 复杂场景或动态效果需精细草图,对用户绘画能力有一定要求。

- 生成速度受计算资源限制,实时性较弱。

- 对复杂光照、材质等细节的还原能力有限。

如何使用

- 安装与配置:

- 下载框架代码(GitHub 仓库)并安装依赖环境(如 PyTorch、CUDA)。

- 配置预训练模型(如 CogVideo-2B)作为基础模型。

- 视频生成:

- 绘制关键帧草图(如角色动作、场景布局)。

- 输入文本描述(可选),指定视频风格或主题。

- 运行生成脚本,框架输出视频序列。

- 视频编辑:

- 导入已有视频,标记需修改的区域。

- 绘制草图覆盖目标区域,运行编辑脚本。

- 调整参数(如草图权重、生成时长)优化结果。

框架技术原理

- 草图编码器:将手绘草图转换为特征向量,提取几何与语义信息。

- 时空注意力网络:分析草图特征与视频帧的关联性,生成动态内容。

- 融合与渲染:将生成内容与原始视频合并,输出最终结果。

框架技术原理

- 基础模型:基于预训练的视频生成模型(如 CogVideo-2B),通过添加可训练的草图控制网络实现可控生成。

- 跳跃式残差控制结构:将控制模块嵌入预训练模型的不同层次,提升控制能力并降低计算开销。

- 帧间注意力机制:利用帧间相似性引导控制信号传播,确保时序一致性。

- 局部融合策略:在隐空间中融合原始视频与编辑结果,保留非编辑区域内容。

框架技术原理

- 基础模型:基于预训练的视频生成模型(如 CogVideo-2B),通过添加可训练的草图控制网络实现可控生成。

- 残差特征预测:通过可训练的线稿控制网络预测残差特征,实现基于草图的可控生成。

- 跳跃式残差控制结构:将条件控制模块嵌入预训练模型的不同层次,减少参数开销并提升控制能力。

- 帧间注意力机制:通过可训练的 DiT 模块提取关键帧控制特征,利用帧间相似性引导控制信号传播,生成时序一致的线稿引导视频。

创新点

- 基于草图的可控生成:首次将线稿控制引入视频生成领域,解决传统方法对复杂输入的依赖。

- 跳跃式残差控制结构:通过稀疏方式传播关键帧控制信号,降低计算开销并提升控制精度。

- 局部融合策略:在隐空间中融合原始视频与编辑结果,实现非编辑区域的精确保留。

评估标准

- 生成质量:通过 PSNR、SSIM 等指标评估视频清晰度与时空一致性。

- 可控性:测试草图与生成视频的几何细节匹配度(如物体形状、位置)。

- 编辑精度:衡量局部修改对非编辑区域的影响(如颜色溢出、边缘模糊)。

- 计算效率:记录单帧生成时间与显存占用,评估实时应用潜力。

创新点

- 跳跃式残差控制结构:通过间隔嵌入控制模块,减少参数开销,提升控制能力。

- 帧间注意力机制:利用帧间相似性传播控制信号,实现时序一致的线稿引导生成。

- 局部融合策略:在隐空间中融合原始视频与编辑结果,保留非编辑区域内容。

评估标准

- 生成质量:通过用户调研评估视频的真实感、连贯性及细节还原度。

- 控制精度:对比用户草图与生成视频的几何细节匹配度,如物体运动轨迹的精准度。

应用领域

- 影视制作:快速生成动画原型,降低前期制作成本。

- 广告创意:通过草图快速生成广告视频,提升制作效率。

- 教育领域:将抽象概念转化为动态视频,辅助教学。

- 个人创作:为艺术家提供低成本、高效的视频创作工具。

项目地址

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...