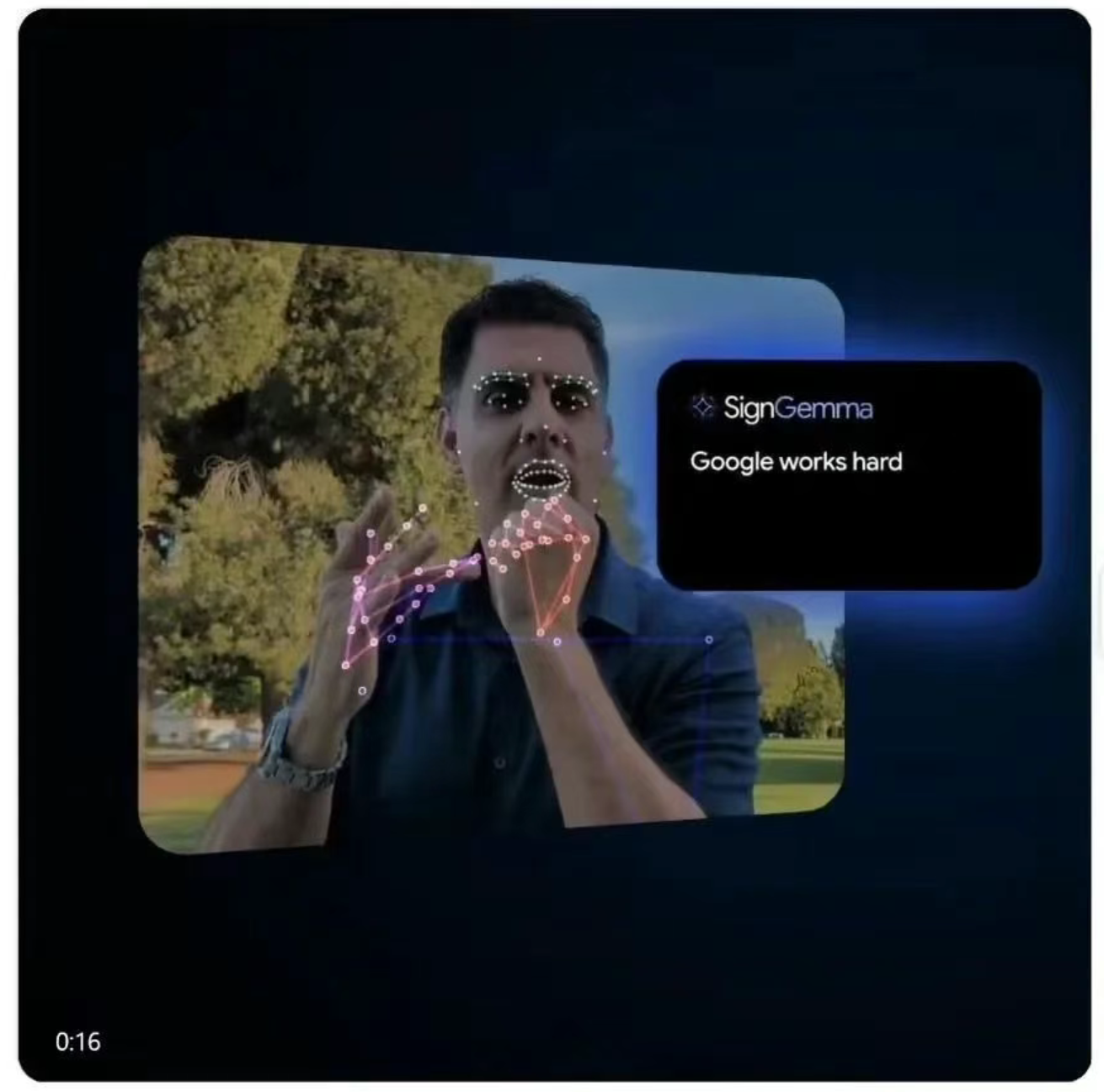

SignGemma:谷歌DeepMind推出的手语翻译AI模型

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

介绍

SignGemma是谷歌DeepMind于2025年5月27日推出的全球最先进的开源手语翻译AI模型,专注于美国手语(ASL)与英语的实时互译。其识别精度和上下文理解能力达到行业顶尖水平,支持手语动作到口语文本的毫秒级转换,延迟低于300毫秒,接近人类对话的自然节奏。该模型基于Gemma3n高效架构,可在2GB内存设备上流畅运行,无需云端依赖,且完全开源,开发者可自由适配至医疗、教育等垂直场景。

功能特点

- 实时互译:支持美国手语(ASL)与英语的实时互译,响应延迟低于0.5秒,接近自然对话节奏。

- 高精度识别:通过多模态训练(视频+文本),能识别手语中的表情、肢体动作等非语言信息,翻译准确率达94.7%。

- 轻量化部署:基于Gemma3n高效架构,可在2GB内存设备(如中低端手机)上流畅运行,无需云端依赖。

- 开源生态:模型完全开源,开发者可自由适配至医疗、教育等垂直场景,未来将扩展至国际手语(IS)和各国本土手语变体。

优缺点

优点:

- 高精度与低延迟:识别准确率高,延迟低,接近自然对话节奏。

- 轻量化与易部署:可在低配置设备上运行,无需云端依赖,适合资源受限场景。

- 开源与可扩展:模型完全开源,开发者可自由适配和优化,支持多语言扩展。

- 隐私保护:支持端侧部署,用户数据无需上传云端,适合医疗、教育等敏感场景。

缺点:

- 数据局限性:当前模型主要基于北美手语数据,对其他地区手语的支持有限。

- 复杂语义理解挑战:手语包含空间语法、表情和肢体动作等多元信息,模型在复杂语义理解上仍有提升空间。

- 硬件需求:虽然支持轻量化部署,但在极端低配置设备上可能仍需优化。

如何使用

- 申请早期测试权限:开发者可通过Gemma官网申请早期测试权限,获取模型代码和权重。

- 适配垂直场景:根据具体需求,适配模型至医疗、教育等垂直场景,如集成至谷歌Meet提供课堂手语翻译字幕。

- 部署与优化:在目标设备上部署模型,并根据实际运行情况进行优化,如调整模型参数或硬件配置。

- 参与开源生态:开发者可贡献代码、数据或反馈,共同完善手语AI生态。

框架技术原理

- 多模态训练:结合视觉与文本数据,解决手语中的空间语法、表情和肢体动作等多元信息识别难题。

- 高效架构设计:基于Gemma3n架构,采用Per-Layer Embeddings(PLE)技术,显著降低内存需求,提升响应速度。

- 实时处理能力优化:通过视觉序列建模和上下文语义理解,优化模型架构以支持实时交互场景。

- 端侧部署支持:模型支持端侧部署,用户数据无需上传云端,适合医疗、教育等敏感场景。

创新点

- 毫秒级实时翻译:支持手语动作到口语文本的毫秒级转换,延迟低于300毫秒,接近自然对话节奏。

- 多模态理解:通过多模态训练,识别手语中的表情、肢体动作等非语言信息,提升翻译准确率。

- 轻量化与开源:基于Gemma3n架构,可在低配置设备上运行,且模型完全开源,支持开发者自由适配和优化。

- 隐私保护设计:支持端侧部署,用户数据无需上传云端,保护用户隐私。

评估标准

- 翻译准确率:通过测试数据集(如WLASL-3000)评估模型的翻译准确率。

- 实时性能:评估模型的响应延迟,确保接近自然对话节奏。

- 资源消耗:评估模型在不同硬件配置下的内存占用和计算资源消耗。

- 多语言支持:评估模型对不同手语变体的支持能力和扩展性。

- 隐私保护:评估模型在端侧部署时的数据隐私保护能力。

应用领域

- 教育辅助:集成至谷歌Meet等平台,为听障学生提供课堂手语翻译字幕。

- 公共服务:试点应用于机场、医院等场所,减少手语翻译员的人力需求。

- 社交沟通:开发实时手语翻译App,帮助听障人士与口语使用者无缝对话。

- 无障碍技术:推动无障碍技术的发展,提升听障人士的社会参与度。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...