6月14日·谢赛宁在CVPR 2025怒斥AI学术圈畸形,揭示学术激励制度缺陷

6月14日·周六 AI工具和资源推荐

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

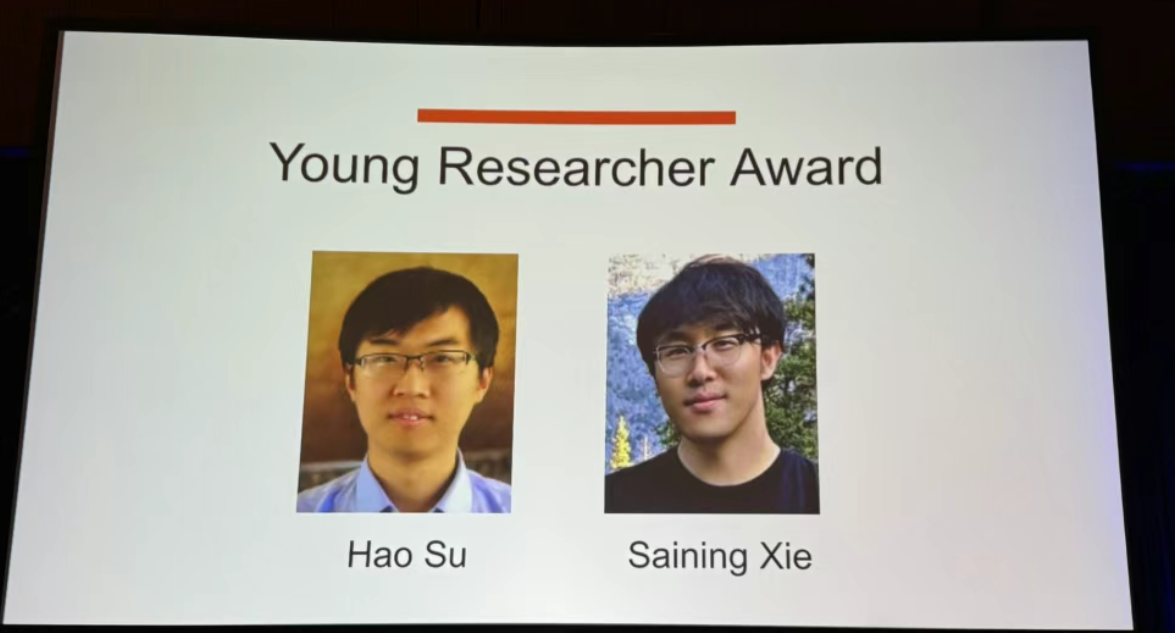

谢赛宁在CVPR 2025怒斥AI学术圈畸形,揭示学术激励制度缺陷

纽约大学助理教授谢赛宁在CVPR 2025上发表演讲,批判当前AI学术界的畸形现状。他指出,学术激励制度存在巨大缺陷,导致研究者陷入内卷,精疲力竭。谢赛宁回顾了自己两篇开创性论文DiT和SiT被CVPR拒收的经历,这两项工作后来分别成为Sora和Stable Diffusion 3的奠基性成果,狠狠打脸了CVPR的评审。他认为,AI研究应是一场“无限游戏”,而非追求短期胜利的“有限游戏”,呼吁研究者追随好奇心与热情,拥抱意外与惊喜,坚持探索,为长远发展贡献力量。来源:微信公众号【新智元】

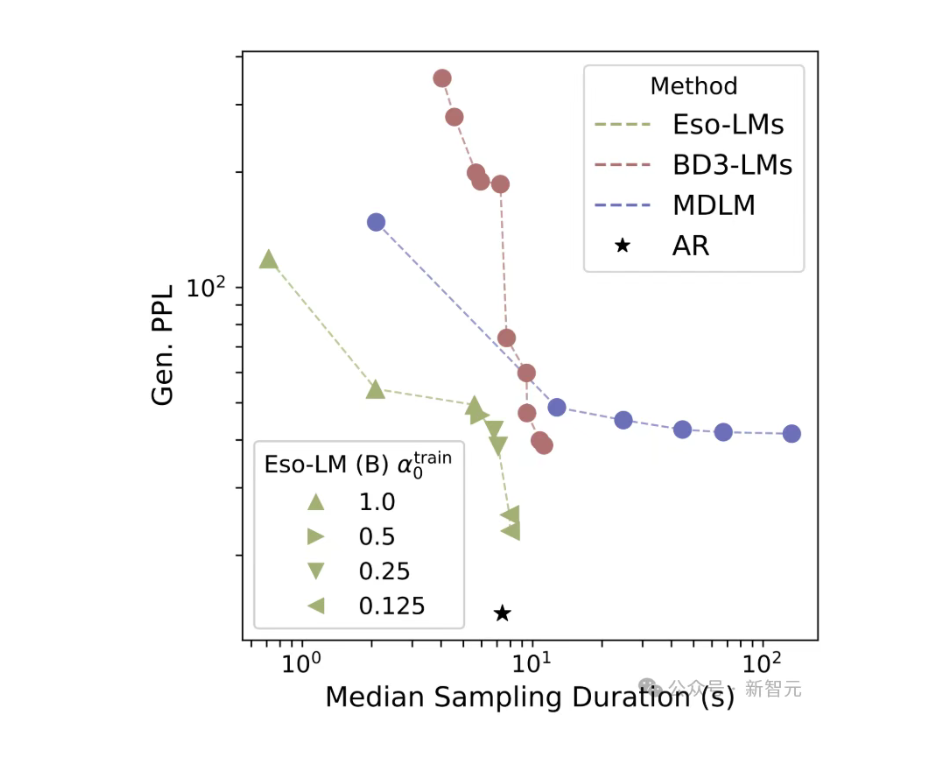

Transformer「混血」模型Eso-LM速度提升65倍,英伟达押注扩散语言模型

康奈尔大学、CMU等机构的研究者提出了一种全新的语言建模框架——Esoteric Language Models(Eso-LMs),将自回归(AR)和离散扩散模型(MDM)相结合,首次引入KV缓存机制,推理速度相比标准MDM提升了65倍,同时在低计算量场景下与离散扩散模型相当,在高计算量场景下与自回归模型相当。该研究为离散扩散模型建立了新的困惑度最优水平,缩小了与自回归模型的差距。英伟达研究院科研总监Arash Vahdat参与其中,显示出英伟达对扩散语言模型的关注与投入。来源:微信公众号【新智元】

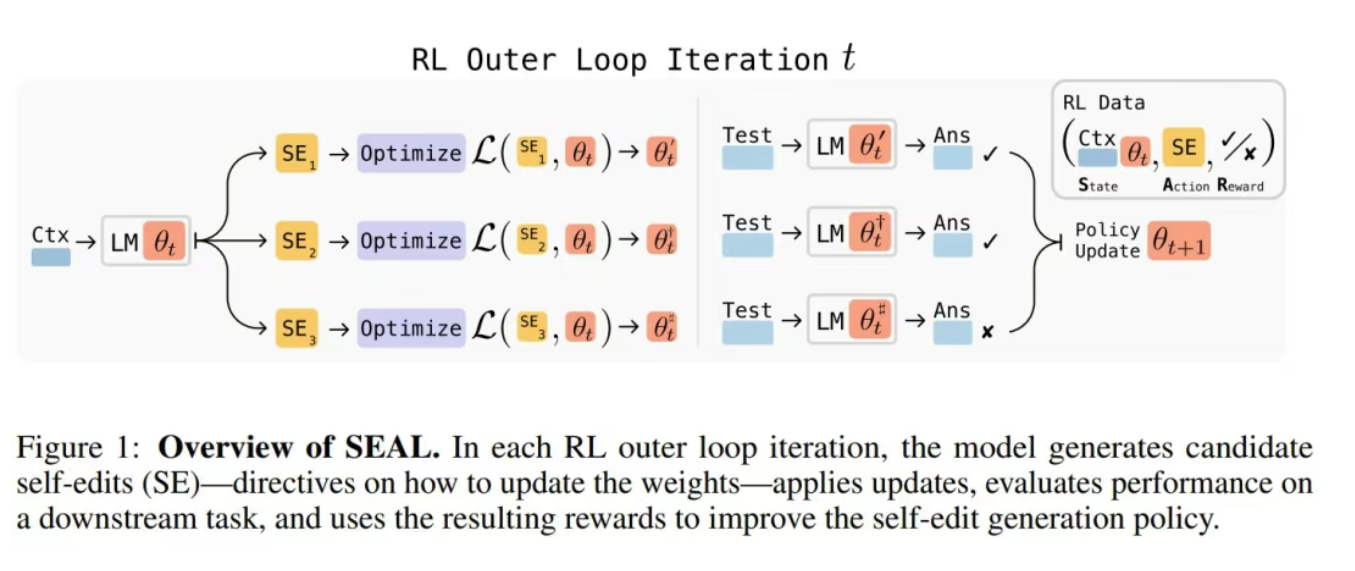

LLM实现自我更新权重,自适应与知识整合能力显著提升

MIT发布了一种名为SEAL(Self-Adapting LLMs)的框架,使语言模型能够通过生成自己的训练数据并更新权重来自我提升。该方法通过强化学习实现自编辑,以提升模型在下游任务中的性能。实验表明,SEAL在少样本学习和知识整合任务中均取得了显著效果,分别将适应成功率提升至72.5%和准确度提升至47.0%。这一成果引发了广泛讨论,被认为可能是AI自我进化的重要一步,但也有观点认为其距离真正的持续自我改进智能体仍有差距。来源:微信公众号【机器之心】

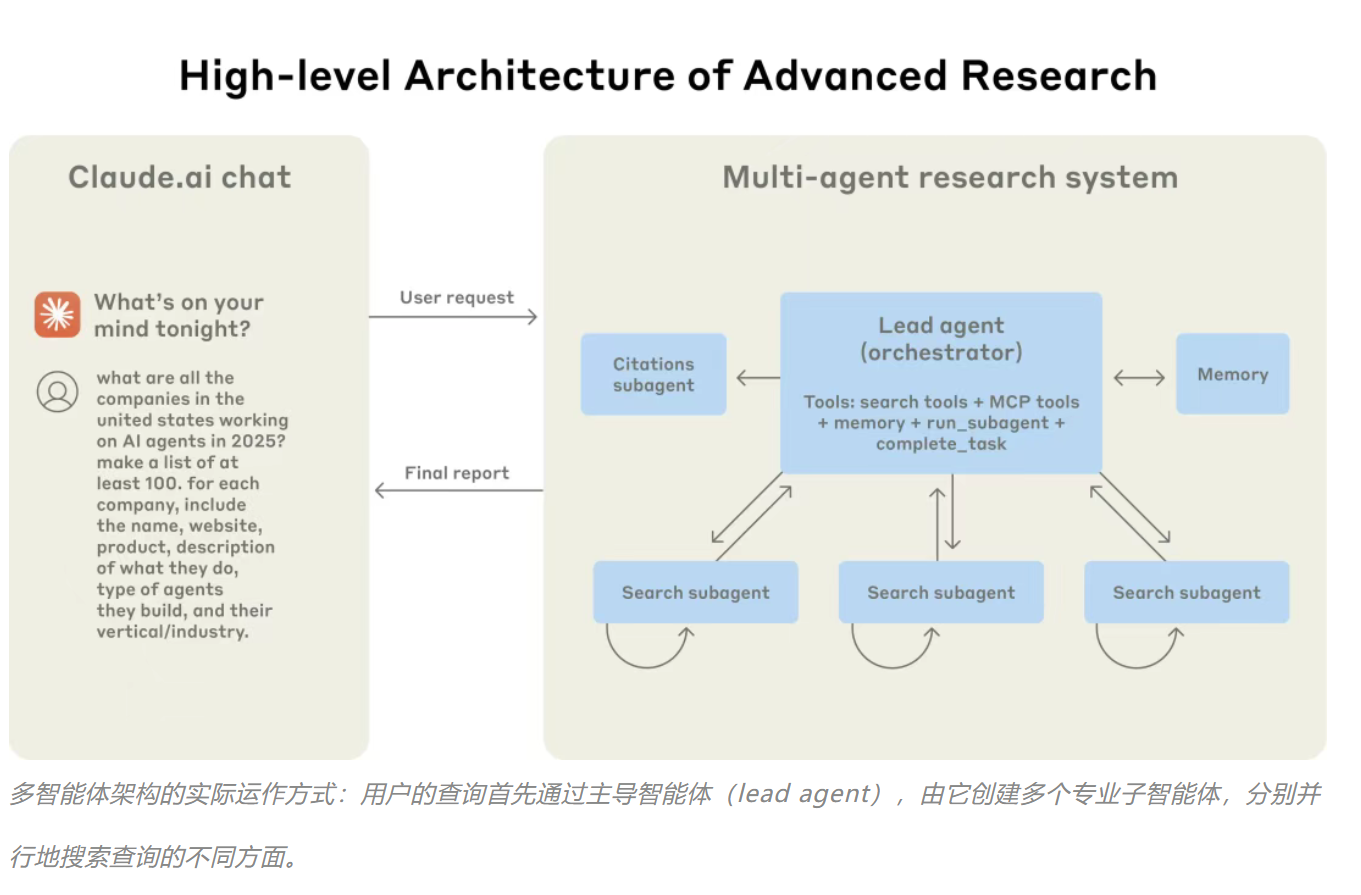

Anthropic发布多智能体系统研究,揭示Token高效利用与系统架构设计

Anthropic近日公开了其多智能体研究系统的详细设计与发现。该系统采用“协调者-执行者”模式,通过多个Claude AI智能体协作完成复杂任务。研究发现,多智能体系统在“广度优先”任务中表现尤为出色,token消耗量是性能差异的关键因素,占80%的解释力。然而,多智能体系统也存在快速消耗Token的缺点,其token使用量是普通交互的15倍。Anthropic通过提示词工程优化智能体行为,采用并行工具调用显著提升效率,并通过LLM担任评审官的方式进行灵活评估。尽管面临工程挑战,多智能体系统在开放式研究任务中展现出巨大潜力,能够有效扩展复杂任务的处理能力。来源:微信公众号【机器之心】

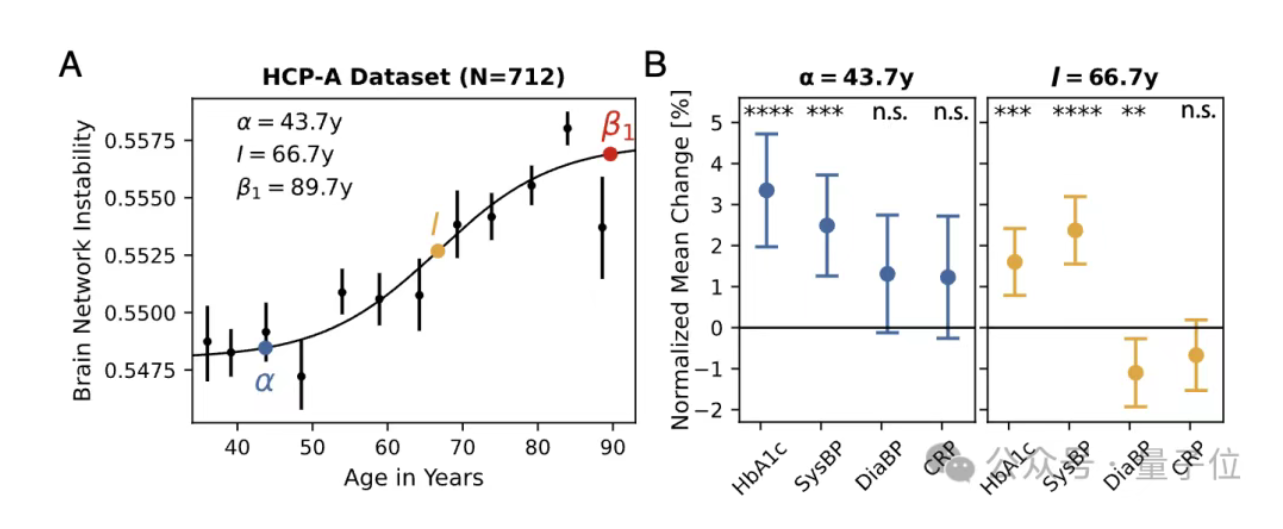

40岁是大脑抗衰关键期!1.9万人脑扫描研究揭示大脑衰老“窗口期”

一项发表于《美国国家科学院院刊》(PNAS)的研究分析了超1.9万人的脑部功能性磁共振成像(fMRI)数据,发现大脑衰老并非匀速线性过程,而是呈现非线性(S形)变化特征。研究指出,大脑衰老与胰岛素抵抗密切相关,而酮体干预可在40-59岁期间显著稳定大脑网络,效果比其他年龄段更突出。这表明40岁是大脑抗衰的黄金干预期,为延缓大脑衰老提供了重要科学依据。来源:微信公众号【量子位】