DeepSeek R1T2 : TNG推出的改进型AI语言模型,基于DeepSeek

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

主要介绍

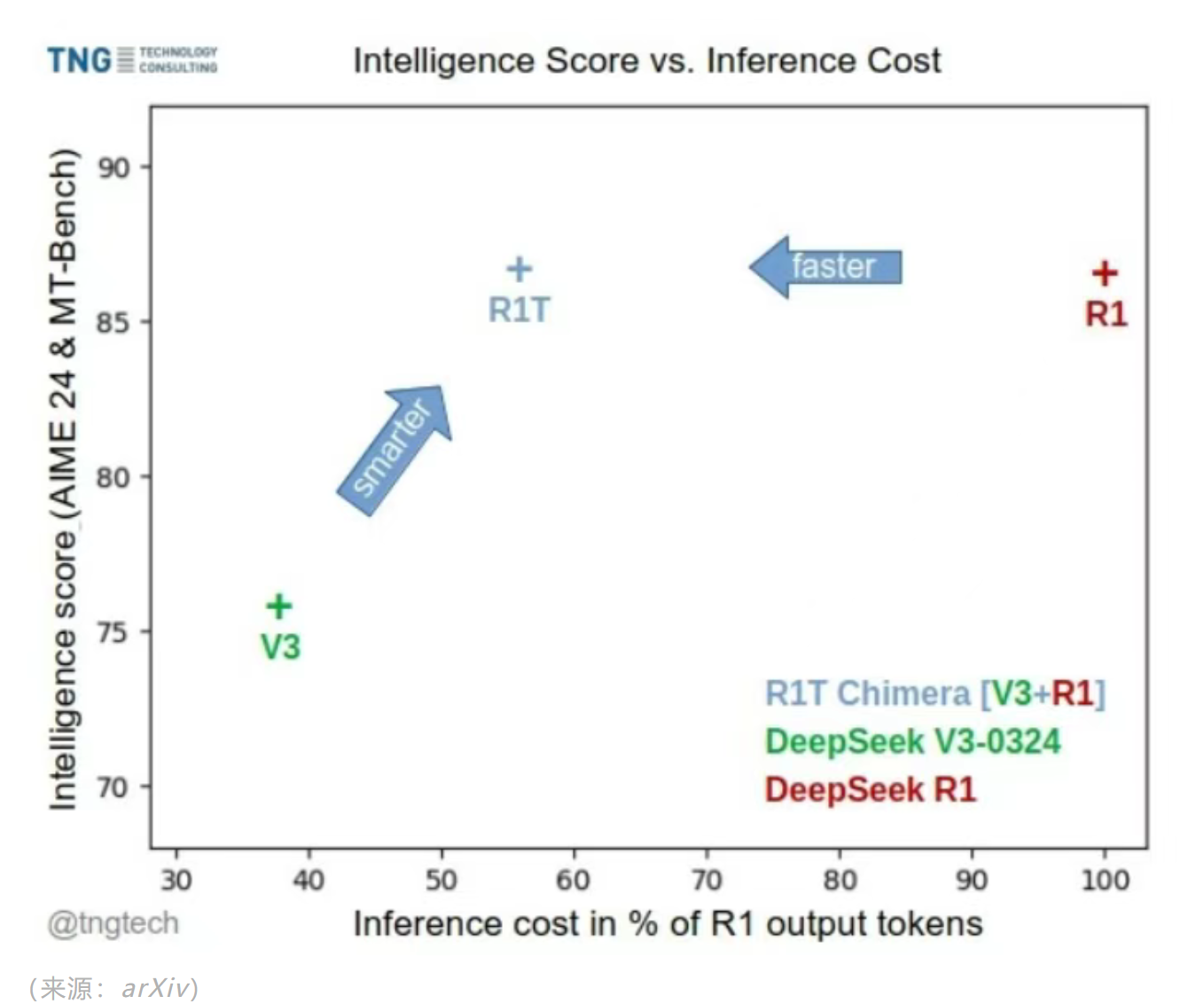

DeepSeek R1T2是德国TNG Technology Consulting团队基于DeepSeek-R1-0528改进的开源混合模型,拥有6710亿参数,核心定位为高效推理与简洁输出。该模型通过TNG提出的集合专家(Assembly-of-Experts, AoE)方法,融合DeepSeek-R1-0528的推理能力、DeepSeek-R1的结构化思维模式及DeepSeek-V3-0324的简洁指令响应特性,在保持推理性能的同时,将输出token量压缩至原模型的40%,输出长度减少60%,推理速度提升200%,显著降低计算成本。其设计突破传统大模型冗长输出的局限,适用于高吞吐量或成本敏感的企业级场景。

功能特点

- 高效简洁输出:

- 输出token量减少60%,推理速度提升200%,直接降低GPU能耗与延迟。

- 在AIME-24、GPQA-Diamond等基准测试中,推理性能达DeepSeek-R1-0528的90%-92%,数学、编程等结构化任务表现突出。

- 开源与可定制:

- 采用MIT许可证,支持私有部署、模型微调及模块化重组,满足企业合规需求。

- 模块化设计:

- 支持通过重组现有模型组件(如专家张量)快速构建定制化变体,降低开发门槛。

优缺点

优势:

- 成本与效率双优:输出token减少直接降低计算成本,推理速度提升适配实时场景。

- 智能无损:推理性能接近顶级模型,但输出更简洁,避免冗长。

- 开源生态:支持私有化部署与二次开发,企业可自主控制数据与模型。

局限:

- 功能边界:暂不支持复杂函数调用、工具集成及高级代理编排。

- 领域适配:虽在科研场景表现优异,但跨领域泛化能力需进一步验证。

如何使用

- 部署方式:

- Hugging Face直接调用:模型已开源至Hugging Face平台,支持通过API或本地加载使用。

- 容器化部署:提供Docker镜像,兼容Kubernetes集群,适配企业级私有云环境。

- GPU集群配置:推荐8卡A800节点,64核CPU及996GB内存,以支持6710亿参数的实时推理。

- 交互模式:

- 命令行/Web UI:通过Ollama服务或Chatbox工具实现文本交互。

- API集成:支持RESTful API调用,可嵌入企业应用(如智能助手、数据分析流水线)。

框架技术原理

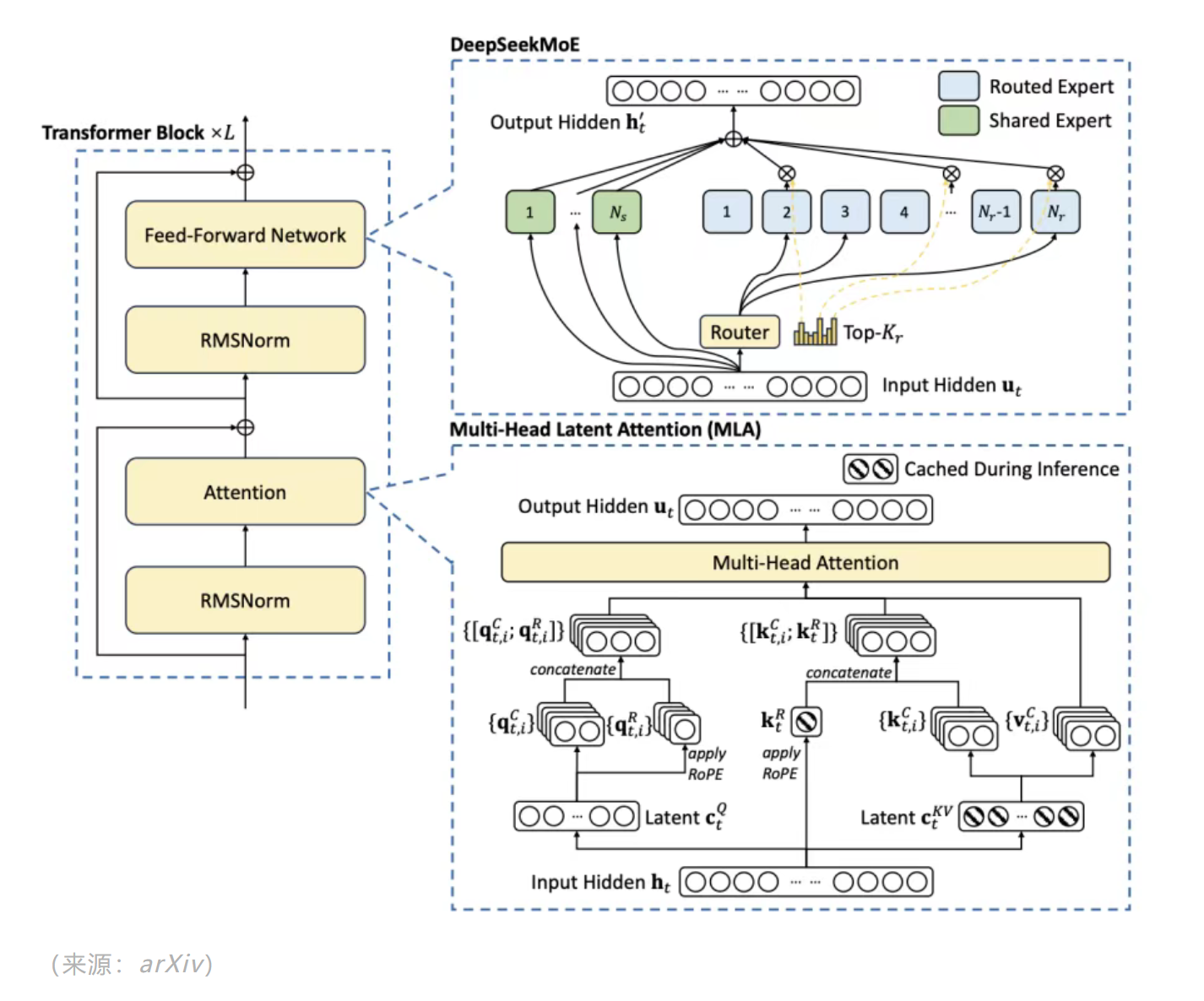

- 集合专家(AoE)方法:

- 通过线性组合父模型(R1-0528、R1、V3-0324)的路由专家张量,生成具备混合能力的子模型,无需重新训练。

- 仅合并张量差异超过阈值的部分,减少冗余计算,提升合并效率。

- 混合专家(MoE)优化:

- 保留父模型中高效共享层(如注意力机制),仅重组推理相关专家模块,平衡专业化与计算成本。

- 采用FP8混合精度训练,关键计算层(如归一化)保留BF16精度,兼顾速度与数值稳定性。

创新点

- 输出效率革命:

- 首次以“输出token量”为核心指标优化模型,突破传统“每秒token数”的局限,实现成本与延迟的双重优化。

- 无训练融合:

- 通过AoE技术直接合并预训练模型权重,无需微调或重新训练,大幅降低模型开发门槛。

- 模块化设计:

- 支持通过重组现有模型组件快速构建定制化变体,预示“乐高式”模型组装未来。

评估标准

- 推理性能:

- 在AIME-24(数学推理)、GPQA-Diamond(多学科问答)等基准测试中,得分与父模型R1-0528的差距控制在10%以内。

- 输出效率:

- 以“每答案输出token数”衡量,较原模型减少60%,推理速度提升200%。

- 成本效益:

- 单位推理任务的GPU能耗降低50%-70%,适用于成本敏感型场景(如边缘计算、物联网设备)。

应用领域

- 科研辅助:

- 解析基因序列、优化分子动力学模拟、处理脑成像数据,加速生物信息学与计算化学研究。

- 企业服务:

- 智能客服(快速响应用户查询)、金融风控(实时分析交易数据)、代码生成(简洁高效的编程建议)。

- 教育场景:

- 自动化作业批改、个性化学习路径规划,支持大规模在线教育平台。

项目地址

- 模型开源:Hugging Face平台

DeepSeek-TNG R1T2 Chimera - 技术文档:TNG官方GitHub仓库

R1T2 Technical Paper - 社区讨论:Hugging Face Discussions板块

R1T2 User Feedback

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...