MirageLSD : Decart AI推出的实时视频生成模型

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

主要介绍

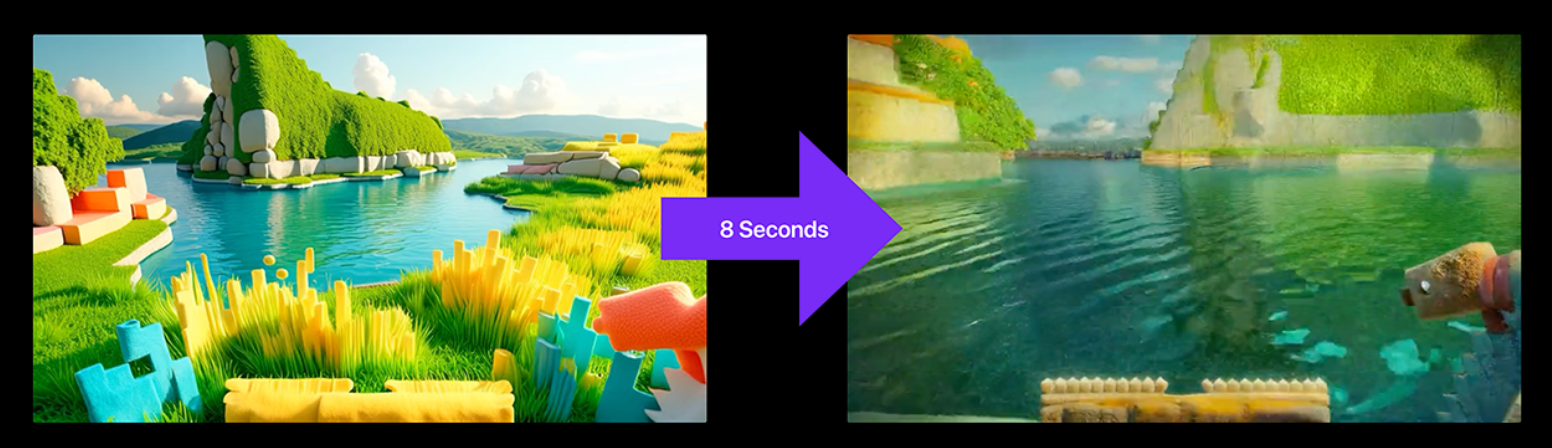

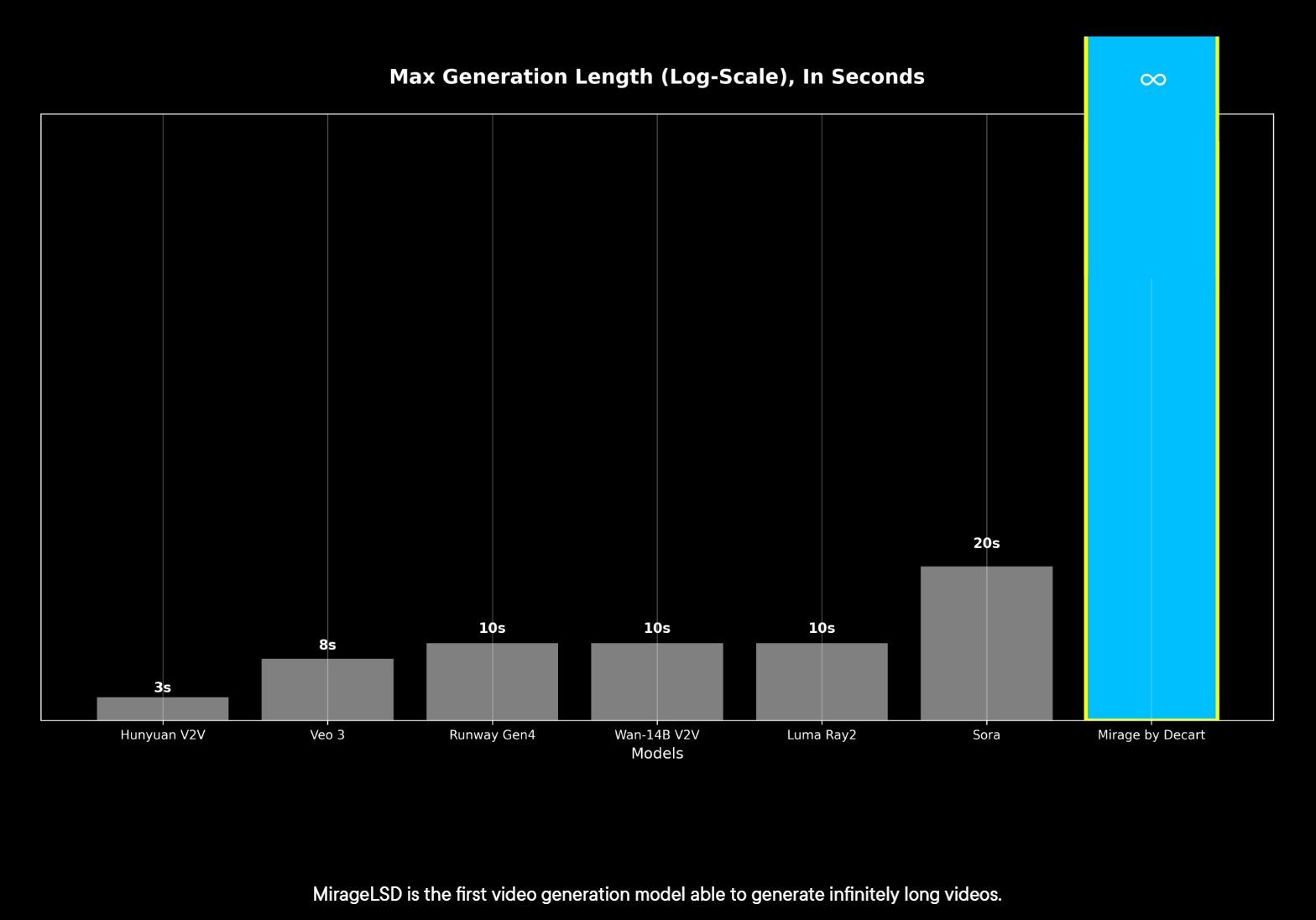

MirageLSD是Decart AI于2025年7月发布的全球首个支持直播推流的实时扩散AI视频模型,首次实现视频生成的“零延迟+无限时长”。该模型以每秒24帧、端到端延迟低于40毫秒的性能,突破传统视频生成模型的时延与长度限制,支持实时交互式视频合成,为直播、游戏、动画制作等领域带来颠覆性变革。

功能特点

- 实时性与无限生成:支持无限时长视频流实时生成,无固定片段限制,延迟低于40毫秒,达到人眼无感知的流畅度。

- 交互式编辑:用户可在视频生成过程中通过文本提示、手势或语音动态调整场景、风格或物体(如“将木棍变为光剑”)。

- 多场景适配:输入源覆盖直播、游戏画面、视频通话、摄像头拍摄等,输出可无缝集成至OBS、XSplit等直播工具或游戏引擎。

- 风格化转换:实时转换视频风格(如吉卜力动画、赛博朋克),或实现虚拟换装、背景替换等特效。

优缺点

- 优点:

- 技术突破性:首次解决自回归模型误差累积问题,支持无限时长生成。

- 低硬件门槛:在RTX 3080及以上GPU上即可运行,优于多数需要高端算力的AI视频模型。

- 易用性:提供Unity/Unreal插件、Python SDK及手势控制接口,降低开发者集成难度。

- 缺点:

- 画质权衡:为追求实时性,采用低分辨率生成+超分网络策略,极端场景下可能损失细节。

- 风格一致性:复杂动态场景(如多人交互)中,风格迁移的稳定性仍需优化。

如何使用

- 在线体验:访问官网体验页面,上传视频或调用摄像头实时生成。

- 开发集成:

- 安装Python SDK:

pip install mirage-lsd - 初始化引擎并启动流:import mirage_lsd engine = mirage_lsd.StreamEngine(model=”mirage-lsd-v1″, device=”cuda”) engine.start(input_source=0, on_frame=engine.render) # 0为摄像头索引

- 安装Python SDK:

- 游戏/Unity开发:导入插件后绑定纹理并调用

StartCapture()API即可实现实时渲染。

框架技术原理

- LSD模型架构:

- 编码器:结合2D/3D卷积提取单帧与跨帧时空特征。

- 时空注意力模块:在U-Net各阶段引入跨帧自注意力机制,保障画面连贯性。

- 解码器:基于注意力融合的潜在向量重建RGB帧,支持动态场景生成。

- 核心优化:

- Diffusion Forcing技术:训练时独立对单帧去噪,减少对完整视频上下文的依赖。

- 历史增强策略:主动添加噪声伪影至历史帧,增强模型对误差的修正能力。

- CUDA超大内核:通过并行计算优化减少帧生成延迟。

创新点

- 实时扩散模型首创:将扩散模型从离线生成推向实时应用,响应速度较前代模型提升16倍。

- 误差修正机制:通过历史帧伪影训练与推理阶段预警,解决自回归模型长期生成的质量衰减问题。

- 全流程低延迟设计:从输入缓冲、光流估计到隐藏态缓存,构建端到端延迟优化管道。

评估标准

- 性能指标:帧率(24FPS+)、端到端延迟(<40ms)、显存占用(8GB GPU可运行)。

- 质量指标:画面连贯性(无闪烁/跳帧)、风格迁移准确度、复杂场景稳定性。

- 交互指标:提示响应速度、多模态控制兼容性(文本/语音/手势)。

应用领域

- 直播行业:实时切换背景、虚拟换装,降低绿幕依赖。

- 游戏开发:30分钟内生成可交互Demo,动态调整游戏世界风格。

- 动画制作:实时预览分镜效果,加速迭代周期。

- 电商营销:观众通过手势试穿虚拟服装,提升购物体验。

项目地址

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...