AudioStory : 腾讯ARC推出的音频生成模型

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

主要介绍

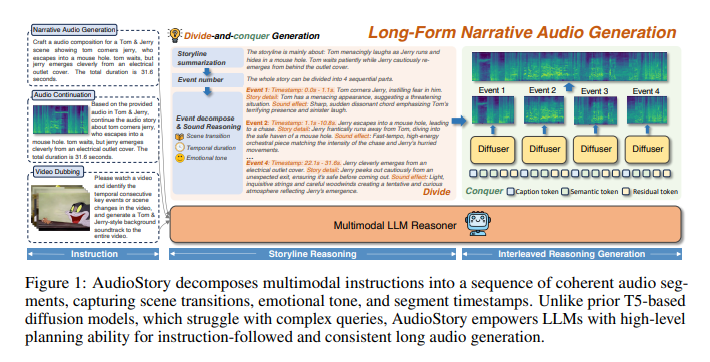

腾讯ARC实验室于2025年9月开源的AudioStory,是一款基于大语言模型(LLM)的长篇叙事音频生成模型。其核心突破在于将复杂文本指令转化为结构化、时间连贯的音频叙事,支持视频配音、音频续写、有声书创作等场景,解决了传统文本到音频(T2A)模型在长时长内容生成中的“碎片化”问题。模型通过端到端训练与解耦桥接机制,实现语义与音效的精准匹配,生成音频在情感基调、场景转换和逻辑连贯性上达到专业水准。

功能特点

- 长篇叙事生成

- 支持最长150秒的连续音频输出,质量稳定不衰减。例如为10分钟睡前故事生成背景音轨时,白噪音音量、人声语调全程保持一致。

- 通过“分而治之”策略,将复杂指令拆解为带时间戳的子任务(如“0-10秒雨声+轻音乐切入”),确保时序清晰。

- 多场景适配

- 视频配音:动态视觉路由技术(ViR)智能识别视频关键区域(如人物动作),高分辨率处理对应音效(如台词、碰撞声),背景区域降采样以降低计算资源消耗。实测显示,处理896px视频时,推理延迟从369ms降至91ms,音画同步误差控制在10ms以内。

- 音频续写:基于给定片段推断后续场景,自动补充合理音效。例如为篮球训练音频添加球员脚步声、篮球拍打声等环境音。

- 有声书创作:根据文本描述生成具有情绪层次的音频,如悬疑场景中钟表滴答声节奏随时间加快,雷声通过混响效果呈现距离感。

- 多语言与风格支持

- 支持13种主流语言(中、英、日等)及24种方言(粤语、四川话等),精准还原发音特征(如粤语“懒音”、英语连读)。

- 可切换音效风格(写实风、动画风),例如为《猫和老鼠》视频生成夸张的追逐音效,为纪录片输出沉稳背景音。

优缺点

优点

- 指令跟随能力强:在AudioStory-10K基准测试中,指令遵循率比基线模型高17.85%,语义匹配度(CLAP指标)提升23%。例如生成“悬疑场景”音频时,滴答声节奏与雷声距离感完全符合预期。

- 音频质量高:Frechet Audio Distance(FAD)指标比基线模型降低约30%,接近真实录音质感。例如钢琴泛音细节、雨声层次感均能精准还原。

- 开源生态完善:采用Apache 2.0协议,支持商业与非商业使用,提供完整部署文档、API调用示例及轻量化部署方案(8B参数模型可在RTX 3060显卡上实时推理)。

缺点

- 硬件要求较高:78B及以上参数模型需数据中心级硬件支持,中小企业部署成本较高。

- 长文本理解局限:在处理超长文本(如整部小说)时,需进一步优化子任务拆解效率。

如何使用

- 环境配置:

- 支持Hugging Face、PyTorch框架,提供4-bit AWQ量化技术以降低显存占用(8B模型量化后显存从12GB降至3GB)。

- 输入指令:

- 自然语言描述场景(如“45秒英文动画配音,《猫和老鼠》风格”)或上传视频文件,明确时长、语言、风格等参数。

- 生成与调优:

- 通过SSML标记语言自定义音频参数(语速、音量),支持迭代优化生成结果。

框架技术原理

- 解耦桥接机制:

- 将LLM与音频生成器协作分解为“桥梁查询”(事件内语义对齐)和“残差查询”(跨事件一致性保存)。例如生成“雨声渐强”时,残差查询动态调整音量衰减曲线,避免突兀切换。

- 端到端训练:

- 统一优化指令理解与音频生成环节,通过三阶段渐进训练(单音效生成→子事件协同→长叙事整合)强化跨事件连贯性。

- 动态视觉路由(ViR):

- 针对视频配音场景,智能识别关键区域并保留高分辨率处理,背景区域降采样以减少计算资源消耗。

创新点

- 语义令牌与残差令牌双通道机制:

- 宏观叙事(语义令牌)与微观音效(残差令牌)分离处理,确保音频既符合整体逻辑又具备细节表现力。

- 多模态语义平衡:

- 在视频配音中综合分析视觉与文本信息,自动平衡不同信息源。例如为海浪视频生成音效时,既响应文本需求,又捕捉人群交谈声、海鸥鸣叫声,形成复合音效。

评估标准

- 指令遵循率:衡量生成音频与文本指令的匹配程度(如音效类型、持续时长、情感基调)。

- 语义匹配度(CLAP):评估音频与文本描述的契合度,减少“文不对音”情况。

- 音频质量指标(FAD):量化生成音频与真实录音的相似度,关注泛音细节、层次感等维度。

- 时序连贯性:通过人工评测检验场景转换的自然度(如雨声渐强与音乐减弱的过渡是否平滑)。

应用领域

- 影视制作:为无声动画片段生成同步音效与台词,完播率比传统人工配音提升40%,制作周期缩短60%。

- 游戏开发:根据剧情动态生成音轨,如战斗场景自动叠加武器碰撞声、角色技能音效,且风格与游戏世界观一致。

- 在线教育:为数学题、科学实验视频生成解说音频,AIME25数学竞赛题解说准确率达75.6%。

- 短视频创作:为英超赛事集锦自动匹配进球欢呼声、解说词,每分钟生成5-8条15秒短视频。

项目地址

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...