RustGPT : AI语言模型,根据输入内容自动文本补全

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

主要介绍

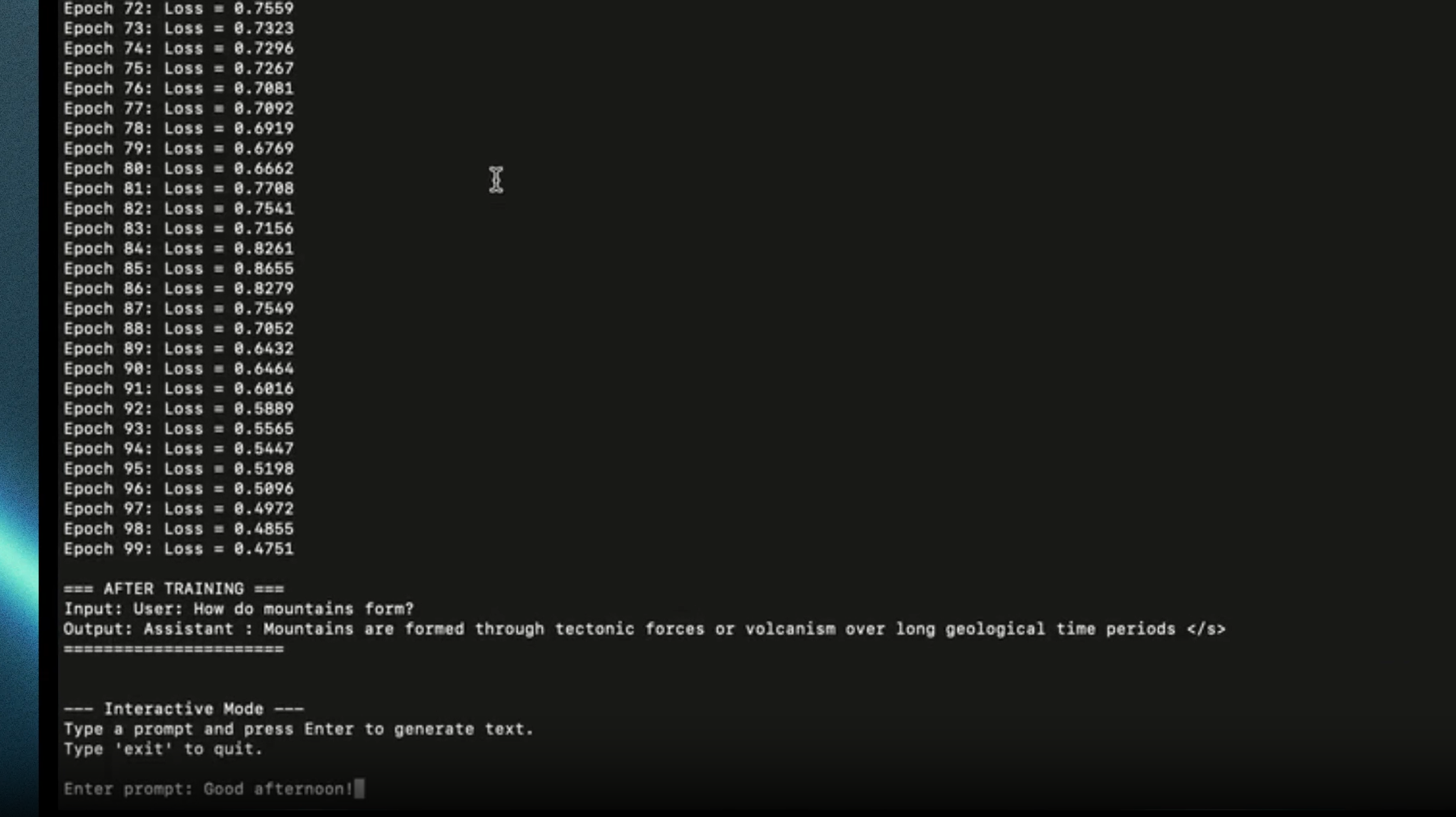

RustGPT 是一个基于 Rust 语言从零构建的纯 Rust 大语言模型(LLM),专注于文本生成与自动补全任务。其核心目标是通过 Rust 的高性能与内存安全特性,解决传统 Python 模型在生产环境中的性能瓶颈与安全问题。RustGPT 复刻了 LLM 的完整功能链,包括预训练、指令微调与交互模式,支持从简洁指令到复杂文本的生成与补全。项目在 GitHub 开源后迅速获得关注,两天内星标数超 1.4k,预示着 AI 开发工具链向系统级安全与效率的转型。

功能特点

- 纯 Rust 实现:

无外部机器学习框架依赖,核心引擎、Transformer 模块、自注意力机制等均由 Rust 编写,确保内存安全与无畏并发。 - 文本生成与补全:

支持从短文本补全(如代码片段、句子续写)到长文本生成(如故事创作、技术文档),示例中可生成连贯的常识问答内容。 - 模块化设计:

架构清晰,包含词嵌入层、自注意力机制、Transformer 模块等,便于开发者理解、修改与扩展。 - 轻量化部署:

通过 Rust 的零成本抽象与编译优化,降低模型推理的硬件门槛,适合端侧设备与资源受限环境。

优缺点

优点:

- 性能卓越:Rust 的编译优化与无全局解释器锁(GIL)特性,使其推理速度显著优于 Python 实现,尤其在高并发场景下。

- 内存安全:所有权系统在编译时消除内存错误,避免 70% 的安全漏洞,适合对稳定性要求高的生产环境。

- 生态兼容:与 Mistral.rs、HuggingFace 的 Candle 框架等 Rust AI 项目互补,形成完整的工具链。

缺点:

- 生态成熟度低:Rust AI 生态仍处于发展阶段,模型库与社区支持不如 Python 丰富,调试工具链待完善。

- 训练成本高:纯 Rust 从零训练大模型需大规模算力与数据,个人开发者部署门槛较高。

如何使用

- 环境配置:

- 安装 Rust 工具链(

rustup)与 Python 依赖(如tokenizers库)。

- 安装 Rust 工具链(

- 加载模型:

- 下载预训练权重(如

rustgpt-7b.bin)或使用 HuggingFace 格式转换工具。

- 下载预训练权重(如

- 文本生成:

- 输入指令并生成文本。

框架技术原理

- Transformer 架构:

基于多层解码器结构,通过自注意力机制捕捉输入序列的长距离依赖关系。每个解码器包含自注意力层、多头注意力层与前馈神经网络,残差连接与层归一化缓解梯度消失。 - 量化与优化:

支持 FP16/INT8 量化,减少内存占用并提升推理速度。结合 Rust 的数据级并行与指令级并行优化,充分利用 CPU/GPU 资源。 - 所有权系统:

Rust 的编译时所有权检查确保线程安全,避免数据竞争,支持高并发推理任务。

创新点

- 系统级安全:

首个纯 Rust 实现的大语言模型,从语言层面消除内存错误,为 AI 部署提供安全基座。 - 轻量化与高性能:

通过 Rust 的零成本抽象与编译优化,在保持模型精度的同时,实现比 Python 更低的延迟与更高吞吐量。 - 开源生态共建:

项目推动 Rust AI 生态发展,吸引开发者贡献模型库、数据集与工具链,形成与 Python/C++ 生态互补的格局。

评估标准

- 生成质量:

通过人工评估与自动指标(如 BLEU、ROUGE)衡量文本连贯性、逻辑一致性与语义准确性。 - 推理性能:

测试不同硬件(CPU/GPU)下的吞吐量(tokens/sec)与延迟(ms/token),对比 Python 基线模型。 - 内存安全:

通过静态分析工具(如cargo-audit)检测内存漏洞,确保模型在生产环境中的稳定性。

应用领域

- 代码补全:

集成至 IDE(如 VS Code)中,根据上下文自动补全 Rust/Python/C++ 代码,提升开发效率。 - 智能客服:

生成连贯的对话回复,支持多轮交互与意图识别,降低企业客服成本。 - 内容创作:

辅助写作、广告文案生成与故事创作,通过 Prompt 工程控制风格与主题。

项目地址

- GitHub 仓库:https://github.com/rustformers/llm

- Hugging Face 模型库:https://huggingface.co/rustformers

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...