Nemotron Speech ASR : 英伟达开源的语音识别模型

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

主要介绍

Nemotron Speech ASR是英伟达开源的专注于低延迟、实时流式语音识别的模型,旨在解决传统流式模型在长语音识别中的累积延迟问题。该模型通过缓存感知架构和增量计算机制,实现了单句转录锁定仅需24毫秒的高效处理,同时支持多档延迟模式,满足从极致速度到高精度的多样化需求。其设计目标是提供高吞吐量、低运行成本的实时语音识别解决方案,适用于游戏语音、实时翻译、会议记录等多种场景。

功能特点

- 低延迟实时识别:单句转录锁定仅需24毫秒,端到端延迟控制在500毫秒以内,确保语音交互的流畅性和即时性。

- 缓存感知架构:通过缓存已处理的语音特征,避免重复计算,有效解决长语音识别中的累积延迟问题。

- 多档延迟模式:支持80ms、160ms、560ms、1.12s等多档延迟模式,用户可根据应用场景灵活调整,无需重新训练模型。

- 高吞吐量与低运行成本:在相同GPU内存限制下可处理更多并行流,显著降低生产环境的运行成本。

- 原生支持标点和大小写:提升识别结果的可读性和实用性。

- 集成语音智能体方案:与Nemotron 3 Nano 30B(LLM)和Magpie(TTS)协同工作,为构建真正的语音智能体提供全面支持。

优缺点

- 优点:

- 实时性极强:24毫秒的单句转录锁定时间几乎超越人类神经反应速度,适用于对实时性要求极高的场景。

- 灵活性强:多档延迟模式满足不同场景需求,无需重新训练模型。

- 效率高:缓存感知架构和增量计算机制显著提高吞吐量,降低运行成本。

- 缺点:

- 模型复杂度较高:缓存感知架构和增量计算机制的实现相对复杂,对硬件资源有一定要求。

- 特定场景优化不足:在极端噪声环境或非标准发音场景下,识别准确率可能受到影响。

如何使用

- 安装NVIDIA NeMo:通过pip安装NeMo工具包,或从源码安装。

- 加载预训练模型:从Hugging Face模型库或NVIDIA NGC平台加载Nemotron Speech ASR预训练模型。

- 配置流式参数:根据应用需求设置分块大小、滑动步长、上下文块数等参数。

- 实时音频处理:通过流式缓冲区实时处理音频数据,执行流式推理并获取识别结果。

- 结果输出:将识别结果输出为文本格式,支持标点符号和大小写。

框架技术原理

Nemotron Speech ASR采用缓存感知架构和增量计算机制,通过维护编码器状态缓存,对已处理的音频特征进行存储。当新音频帧到来时,直接调用缓存,仅计算当前增量部分,避免重复计算历史数据。这种设计有效解决了长语音识别中的累积延迟问题,同时支持多档延迟模式,通过动态调整上下文大小参数,平衡识别准确率和延迟。

创新点

- 缓存感知流式架构:弃用滑动窗口的重叠计算模式,通过缓存历史计算状态,实现内存消耗的线性扩展,彻底消除计算冗余。

- 动态延迟调整:支持在推理阶段实时切换不同延迟模式,无需重新训练模型,满足多样化场景需求。

- 高并发吞吐表现:单张H100 GPU可同时支持560个并发流,吞吐量较前代方案提升300%。

评估标准

- 词错误率(WER):衡量识别结果与真实文本之间的差异,是ASR评测的黄金标准。

- 句子准确率(SAR):要求整句完全正确才计为成功,适用于对准确性要求极高的场景。

- 实时率(RTF):衡量模型处理语音的实时性,理想值应小于1。

- 场景化定制指标:如医疗场景中的术语识别准确率、金融场景中的数字与金额识别准确率等。

应用领域

- 实时语音助手:为智能语音助手提供低延迟的语音识别能力,实现即时响应用户的语音指令。

- 游戏语音交互:支持低延迟的语音聊天和指令识别,增强玩家之间的实时沟通和互动。

- 实时翻译:用于多语言环境下的实时语音翻译,快速将一种语言的语音内容转换为另一种语言的文字或语音。

- 会议记录:提供高精度的语音转文字功能,实时生成会议记录,提高会议效率。

- 直播互动:为观众提供实时字幕,增强观众的参与感和互动体验。

- 客服系统:快速识别用户语音问题并提供即时响应,提升客服效率和用户满意度。

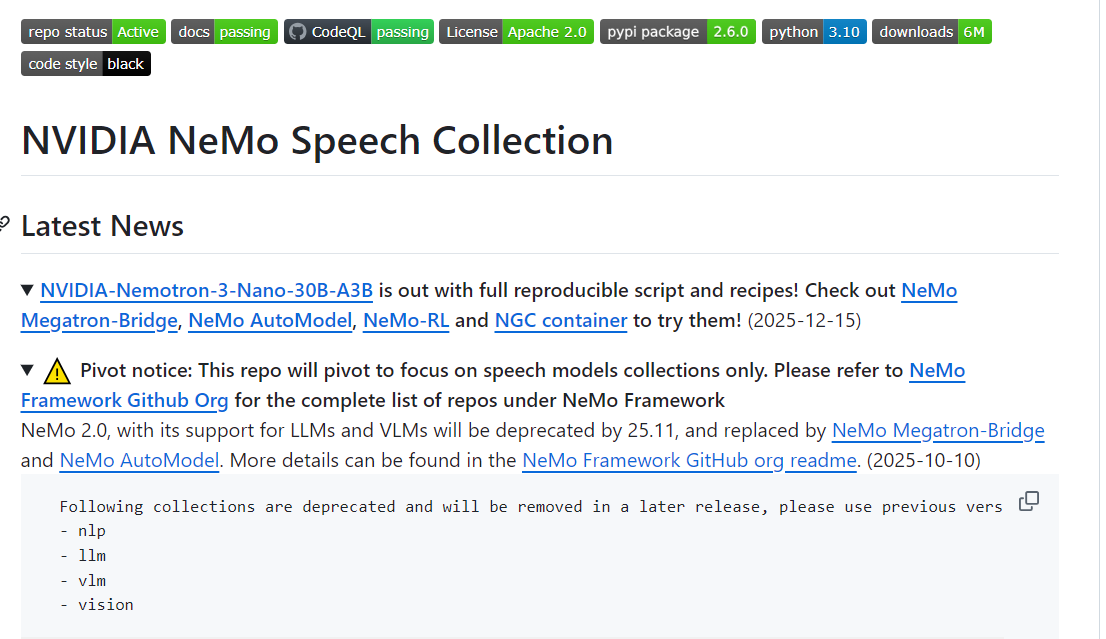

项目地址

- Github仓库:https://github.com/NVIDIA-NeMo/NeMo

- HuggingFace模型库:https://huggingface.co/nvidia/nemotron-speech-streaming-en-0.6b

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...