Youtu-LLM : 腾讯Youtu团队开源的轻量级语言模型

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

主要介绍

Youtu-LLM是腾讯优图实验室推出的一款轻量级语言模型,参数规模仅为1.96B。与依赖知识蒸馏的典型小模型不同,Youtu-LLM采用从零开始的预训练方式,旨在系统性地培养推理与规划能力。该模型在智能体任务中表现出色,树立了2B以下规模大语言模型的新标杆,证明了轻量化模型同样可以具备强大的内在智能体能力。

功能特点

- 长上下文处理能力:基于稠密的多隐变量注意力(Multi-Latent Attention,MLA)架构,支持高达128k的上下文窗口,能够在极小的内存占用下实现鲁棒的长文本推理与状态跟踪。

- 多阶段预训练策略:通过“常识-STEM-智能体”三阶段课程化训练,逐步将预训练数据从通用常识转向复杂的STEM和智能体任务,确保模型获得深层认知能力。

- 智能体轨迹合成:在数学、编程和工具调用领域合成了丰富多样的执行轨迹,使模型能够有效内化规划和反思行为。

优缺点

优点:

- 轻量化与高性能:在参数规模远小于主流大模型的情况下,性能与更大模型相当,甚至在智能体任务中超越现有SOTA基线。

- 原生智能体能力:通过预训练阶段注入智能体思维范式,模型能够内化规划、执行、反思等能力,实现轻量但原生智能。

- 资源友好:适合资源有限的场景,如设备端部署,降低训练和部署成本。

缺点:

- 数据依赖:复杂任务场景下需大量高质量训练数据优化性能。

- 特定领域表现:在非STEM或非智能体任务中的表现可能不如专门优化的大模型。

如何使用

- 访问在线Demo:腾讯可能提供在线Demo或API服务,用户可通过网页界面输入自然语言指令,体验模型的推理与规划能力。

- 使用预训练模型:通过Hugging Face等平台下载预训练模型权重,利用现有工具(如Gradio、Streamlit)快速搭建交互界面。

- 集成到现有系统:参考GitHub仓库中的文档,通过HTTP请求调用模型服务(需自行部署或使用云服务)。

框架技术原理

- MLA架构:通过低秩压缩KV缓存并扩大中间投影矩阵,提升注意力表达能力和推理性能。

- STEM领域专用分词器:优化数学、代码等领域的分词效率,支持128k上下文窗口。

- 多阶段预训练:从常识预训练到STEM与代码预训练,再到通用中训练与长上下文扩展,最后通过智能体中训练内化智能体行为模式。

创新点

- 原生智能体能力诱导:通过分词器设计、数据分配和多阶段学习策略,提出了一种增强原生智能体能力的原则性训练范式。

- 可扩展的智能体轨迹构建:提出了一系列可扩展的框架,用于构建高质量的智能体轨迹数据,涵盖数学、编程、深度研究和通用工具使用等多个领域。

- 智能体思维链范式:将线性思考过程重构为分析、计划、行动、反思、总结五阶段结构化轨迹,培养更强的规划与反思能力。

评估标准

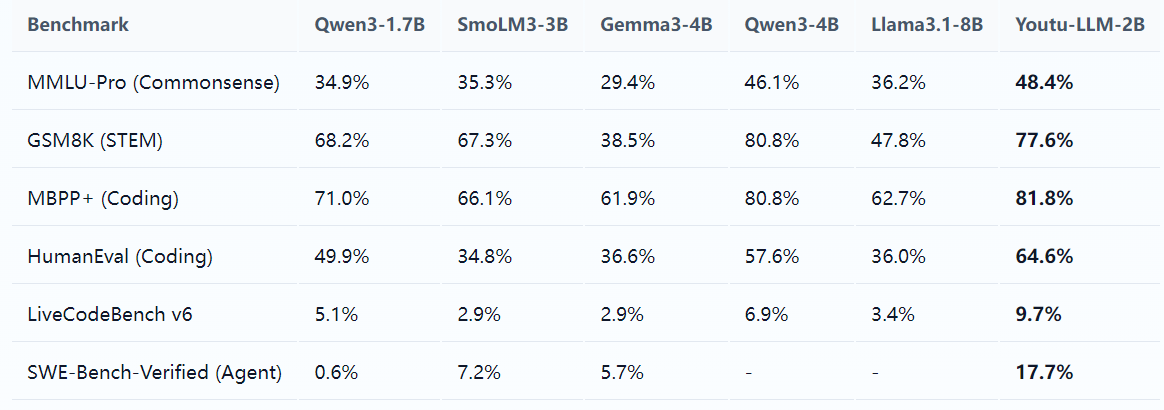

- 通用基准测试:在MMLU-Pro、GSM8K、HumanEval等基准上评估模型的通用语言能力。

- 智能体基准测试:在APT-Bench、GAIA、SWE-Bench-Verified等基准上评估模型的智能体任务完成能力。

- 主观听感测试:通过人工评估合成语音的自然度、相似度与指令遵循度(如适用)。

应用领域

- 设备端部署:适合资源有限的场景,如手机、IoT设备等。

- 自动化任务:自动修复代码漏洞、完成学术研究调研、独立使用工具解决复杂问题。

- 智能客服:通过集成到客服系统,提升意图识别和问题解决能力。

- 教育娱乐:生成教学课件、个性化学习路径和在线课程内容。

项目地址

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...