TeleChat3 : 中国电信推出的千亿参数MoE语义大模型

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

主要介绍

TeleChat3是中国电信人工智能研究院(TeleAI)自主研发的千亿参数细粒度MoE(Mixture-of-Experts)语义大模型,采用全国产算力训练,支持多轮对话、文本创作、代码生成等任务。该模型包含105B参数(实际激活4.7B),通过192个路由专家实现精准知识调用,擅长处理复杂任务如游戏设计、网页开发等。TeleChat3的推出标志着我国在超大规模人工智能模型自主可控方向上迈出了重要一步。

功能特点

- 全栈国产化:依托上海临港国产万卡算力池训练,深度适配华为昇腾生态,包括昇腾Atlas800T A2训练服务器和昇思MindSpore框架,训练与推理全流程运行于国产AI算力基础设施。

- Thinking模式:引入“思考模式”,通过在对话模板中加入特定引导符号,模型可自动生成中间推理步骤,显著提升在复杂任务中的逻辑性与准确性。

- 多任务支持:支持多轮对话、文本创作、代码生成、知识问答、逻辑推理等任务,能高效拆解任务需求,整合多项代码能力,一次性交付完整可运行的代码。

- 高质量数据训练:基础训练数据量高达15万亿tokens,确保模型的泛化能力和准确性。

优缺点

- 优点:

- 自主可控:全栈国产化,摆脱对海外算力基础设施的依赖,为政务、能源、金融等关键领域提供安全无后门的技术路径。

- 逻辑性强:Thinking模式使模型在回答复杂问题时能进行多阶段推理与自我校验,提升答案的准确度与可靠性。

- 任务覆盖广:支持多种任务,且在实际应用中表现突出,如代码生成、知识问答等。

- 缺点:

- 模型规模大:千亿参数规模对存储和计算资源要求较高,可能限制在资源有限环境下的部署。

- 技术门槛:虽然提供了非编码版使用方式,但深入理解和优化模型仍需要一定的技术背景。

如何使用

- 访问项目主页或GitHub仓库:了解TeleChat3的详细介绍、任务类型和使用示例。

- 利用网页工具或魔搭平台:通过提供的网页工具或魔搭(ModelScope)平台,无需编写代码即可与模型进行交互,体验其多轮对话、文本创作等功能。

- 参考使用指导文档:阅读项目提供的使用指导文档,了解如何加载和使用模型,以及如何利用Thinking模式进行复杂任务推理。

框架技术原理

TeleChat3采用细粒度Mixture-of-Experts(MoE)架构,包含1个共享专家和192个路由专家,每次激活4个专家。模型通过路由机制将输入token分配给最合适的专家进行处理,实现精准知识调用。同时,TeleChat3支持长文推理优化,通过NTK-aware外推和attention scaling方法,能将在较短长度上微调的模型在推理时外推到更长的长度。

创新点

- 全栈国产化:实现了从算力到框架的全链路自主可控,为国产大模型提供了安全可靠的技术路径。

- Thinking模式:引入中间推理步骤生成机制,使模型在回答复杂问题时具备更强的逻辑一致性与推理可追溯性。

- 大规模数据训练:利用15万亿tokens的高质量数据进行训练,提升模型的泛化能力和准确性。

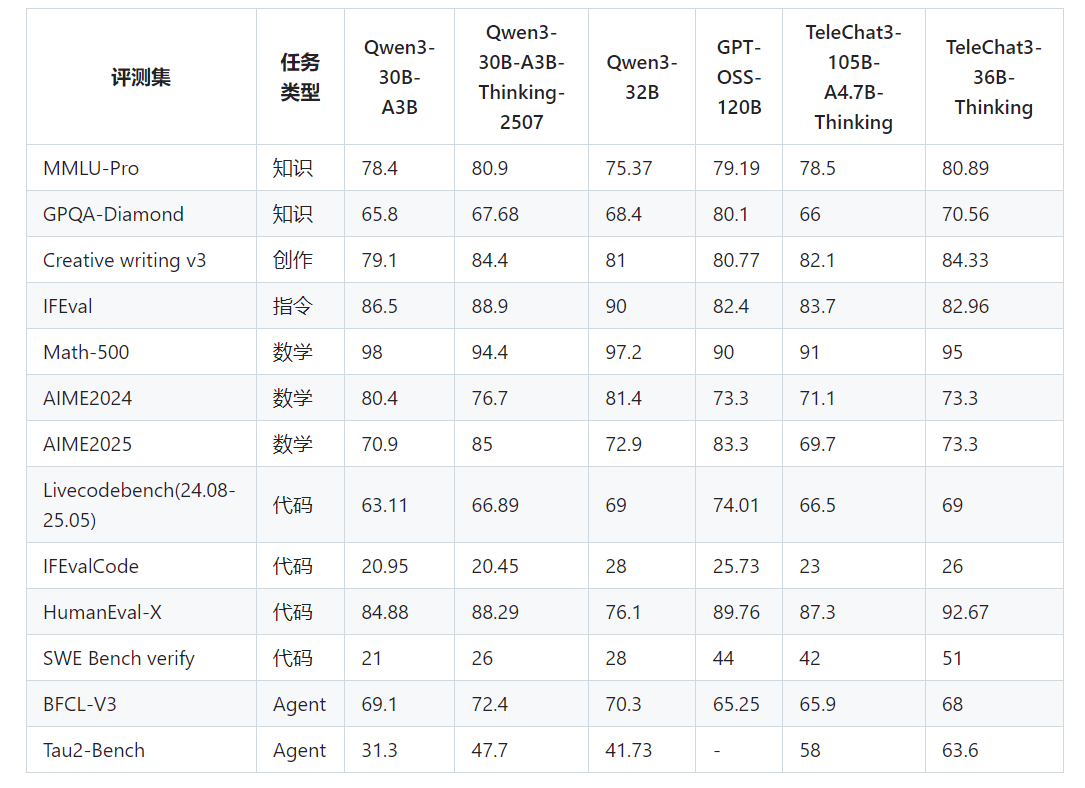

评估标准

- 任务准确率:评估模型在多轮对话、文本创作、代码生成、知识问答等任务上的准确率。

- 逻辑性与准确性:通过Thinking模式生成的中间推理步骤,评估模型在复杂任务中的逻辑性与准确性。

- 训练效率与稳定性:评估模型在训练过程中的效率和稳定性,包括训练时间、内存消耗等指标。

应用领域

- 智能客服:利用模型的多轮对话和知识问答能力,提供高效准确的客户服务。

- 政务问答:为政务信息服务提供多轮问答能力,处理相关领域的专业问题并进行信息推送。

- 代码生成与开发辅助:帮助开发者快速实现编程任务,提高开发效率。

- 文本创作与内容生成:生成高质量的文本内容,满足不同文本创作需求。

项目地址

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...