LLaVA-KD——多模态大语言模型(MLLM)的知识蒸馏框架

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

LLaVA-KD的主要介绍

LLaVA-KD作为一种结合LLaVA大语言模型与知识蒸馏(KD)技术的多模态大语言模型框架,旨在通过知识蒸馏的方法,将LLaVA大模型的复杂知识和能力压缩到较小的模型中,同时保持较高的性能和准确率。LLaVA-KD是一种创新的多模态大语言模型框架,它结合了LLaVA大语言模型的强大能力和知识蒸馏技术的优势。通过知识蒸馏,LLaVA-KD能够将LLaVA大模型的复杂知识有效地传递给较小的模型,从而在保持模型性能的同时,显著降低模型的计算成本和存储需求。这种框架特别适用于资源受限的环境,如移动设备和嵌入式系统。

LLaVA-KD的功能特点

- 知识蒸馏:通过LLaVA大模型作为教师模型,指导较小的学生模型学习,从而实现知识的有效传递。

- 多模态支持:能够处理和理解多种模态的数据,如文本、图像、音频等。

- 高效性:较小的学生模型在保持较高性能的同时,具有更低的计算成本和存储需求。

- 灵活性:可以根据实际需求定制不同的学生模型架构和参数,以适应不同的应用场景。

LLaVA-KD的优缺点

优点:

- 性能优越:通过知识蒸馏,LLaVA-KD能够在保持较高性能的同时,显著降低模型的计算成本和存储需求。

- 多模态支持:能够处理和理解多种模态的数据,适用于多种应用场景。

- 灵活性高:可以根据实际需求定制不同的学生模型架构和参数。

缺点:

- 训练复杂度:知识蒸馏过程需要精心设计和调参,以确保学生模型能够有效地学习教师模型的知识。

- 数据依赖:LLaVA-KD的性能在很大程度上依赖于用于知识蒸馏的训练数据的质量和数量。

如何使用LLaVA-KD

使用LLaVA-KD通常涉及以下几个步骤:

- 准备数据:收集和准备用于知识蒸馏的训练数据。

- 定义模型:定义教师模型(LLaVA大模型)和学生模型(较小的模型)。

- 知识蒸馏:使用LLaVA大模型作为教师模型,指导学生模型进行学习,通过优化损失函数使学生模型的输出尽可能接近教师模型的输出。

- 评估和调优:对学生模型进行评估,并根据评估结果进行调优,以提高模型的性能。

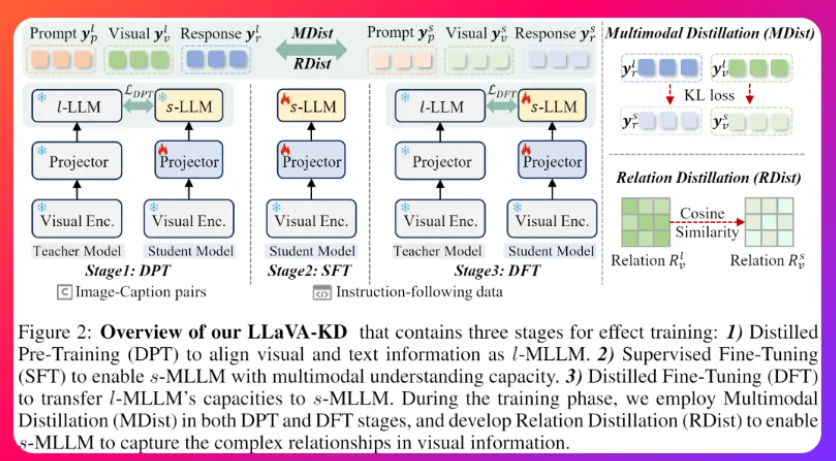

LLaVA-KD的框架结构

LLaVA-KD的框架结构通常包括以下几个部分:

- 教师模型:LLaVA大模型,负责提供知识和指导。

- 学生模型:较小的模型,负责从教师模型中学习知识。

- 知识蒸馏模块:负责将教师模型的知识传递给学生模型,通常包括损失函数的定义和优化算法的实现。

LLaVA-KD的创新点

LLaVA-KD的创新点在于将知识蒸馏技术应用于多模态大语言模型框架中,实现了将复杂大模型的知识有效地传递给较小的模型,从而在保持模型性能的同时,显著降低模型的计算成本和存储需求。这种创新为资源受限的环境下的多模态语言模型应用提供了新的解决方案。

LLaVA-KD的评估标准

评估LLaVA-KD的性能通常涉及以下几个标准:

- 模型准确率:衡量学生模型在测试数据上的准确率。

- 模型大小:衡量学生模型的参数量和计算成本。

- 推理速度:衡量学生模型在推理过程中的计算效率。

- 泛化能力:衡量学生模型在未见过的数据上的表现。

LLaVA-KD的应用领域

LLaVA-KD的应用领域非常广泛,包括但不限于:

- 移动设备与嵌入式系统:在这些资源受限的环境下,LLaVA-KD能够提供高性能的多模态语言模型支持。

- 智能客服:通过LLaVA-KD,可以实现高效、智能的客服系统,提高客户满意度。

- 内容创作:利用LLaVA-KD的多模态理解能力,可以生成高质量、富有创意的内容。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...