Titans —— 谷歌推出的新型神经记忆架构

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在[图片]这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的o g zAI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

Titans主要介绍

Titans是谷歌研究院推出的一种新型神经记忆架构,旨在解决现有深度学习模型在处理长序列数据时存在的局限性。该架构通过引入一个能够在测试时动态学习和更新的神经长期记忆模块,显著提高了模型在处理长文本和复杂任务时的性能。Titans的设计灵感来源于人类记忆系统,结合了短期记忆和长期记忆机制,实现了高效的信息存储和检索。

Titans功能特点

- 神经长期记忆模块:Titans的核心组件是一个能在测试时动态学习和更新的神经长期记忆模块。该模块通过梯度更新来动态学习记忆,具有自适应遗忘机制,能够有效管理有限的记忆容量。

- 基于“惊奇度”的记忆更新:Titans的记忆模块基于“惊奇度”指标进行更新,该指标源于网络关联记忆损失相对于输入的梯度。梯度越大,说明输入越出人意料,因此更容易被记住。

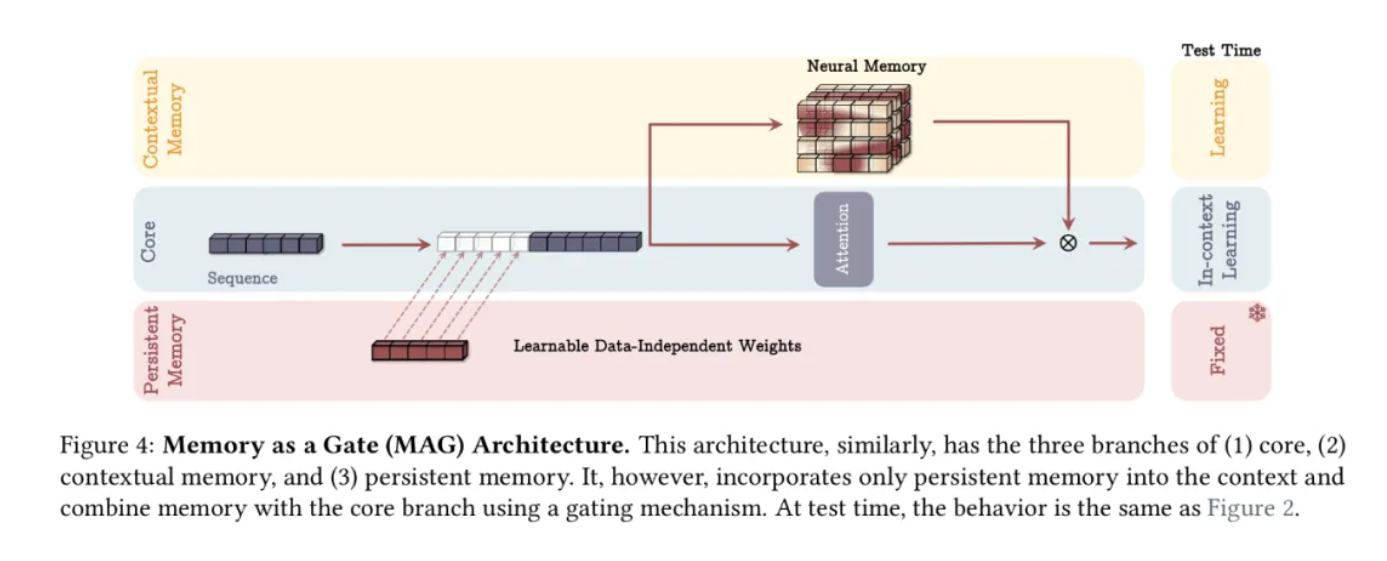

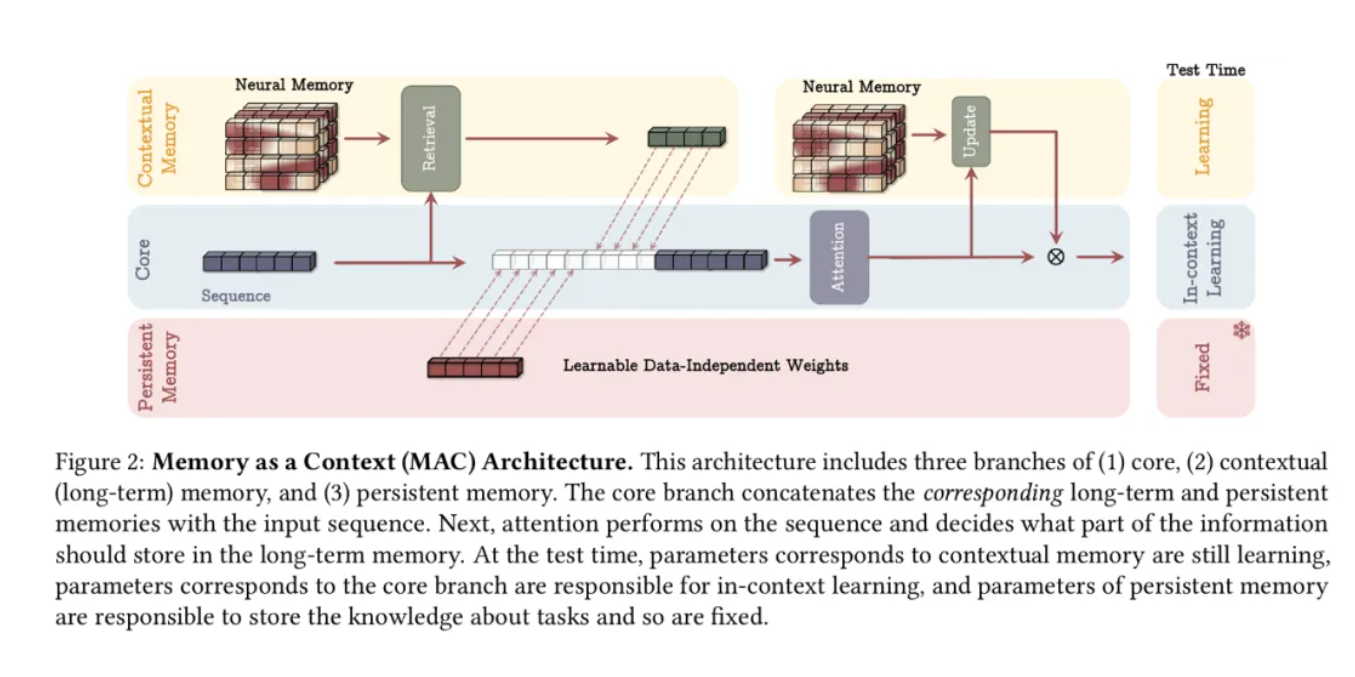

- 多种记忆整合方式:Titans提供了三种不同的记忆整合方式,包括记忆作为上下文(MAC)、记忆作为门控(MAG)和记忆作为层(MAL),以适应不同的任务需求。

- 高效的并行训练:Titans采用了一种基于张量化小批量梯度下降的并行训练方法,显著提高了模型的训练效率。

Titans优缺点

优点:

- 处理长序列能力强:Titans能够高效地处理长序列数据,显著优于现有的Transformer和现代线性循环模型。

- 记忆更新机制先进:基于“惊奇度”的记忆更新机制使得Titans能够更准确地记住重要信息,忽略无关信息。

- 多种记忆整合方式:提供了多种记忆整合方式,使得Titans能够适应不同的任务需求。

- 高效的并行训练:采用高效的并行训练方法,显著提高了模型的训练效率。

缺点:

- 训练速度有待提升:尽管Titans采用了高效的并行训练方法,但其训练速度仍然有提升空间。

- 参数调整复杂:Titans的性能对参数调整较为敏感,需要精细的调参才能达到最佳效果。

- 模型复杂度高:Titans架构相对复杂,对计算资源要求较高。

如何使用Titans

使用Titans通常需要具备一定的技术背景和资源。用户可以通过谷歌研究院或相关开源平台获取Titans的模型和代码,然后按照说明进行部署和使用。具体步骤如下:

- 下载模型和代码:从谷歌研究院或相关开源平台下载Titans的模型和代码。

- 环境配置:安装必要的软件和库,配置计算资源。

- 模型训练:使用提供的数据集对模型进行训练,调整参数以优化性能。

- 模型部署:将训练好的模型部署到目标设备上,进行实际应用。

Titans框架结构

Titans的框架结构主要包括以下几个部分:

- 核心模块:负责处理当前上下文窗口内的信息,采用短期注意力机制。

- 神经长期记忆模块:负责存储和检索重要的远距离历史信息,通过梯度更新来动态学习记忆。

- 持久记忆模块:一组与数据无关的可学习参数,用于存储任务相关的先验知识。

- 记忆整合方式:包括记忆作为上下文(MAC)、记忆作为门控(MAG)和记忆作为层(MAL)三种方式,以适应不同的任务需求。

Titans创新点

- 神经长期记忆模块:Titans首次提出了一个能够在测试时动态学习和更新的神经长期记忆模块,显著提高了模型在处理长序列数据时的性能。

- 基于“惊奇度”的记忆更新机制:借鉴了人类记忆系统的特点,设计了基于“惊奇度”的记忆更新机制,使得模型能够更准确地记住重要信息。

- 多种记忆整合方式:提供了多种记忆整合方式,使得Titans能够适应不同的任务需求,提高了模型的灵活性和适用性。

Titans评估标准

评估Titans的性能时,可以考虑以下几个方面:

- 处理长序列数据的能力:通过对比实验,评估Titans在处理长序列数据时的性能提升。

- 记忆更新机制的准确性:通过对比实验,评估Titans的记忆更新机制是否能够更准确地记住重要信息。

- 多种记忆整合方式的效果:通过对比实验,评估不同记忆整合方式在不同任务上的表现。

- 模型的训练效率和推理速度:评估Titans的训练效率和推理速度,以确定其在实际应用中的可行性。

Titans应用领域

Titans的应用领域广泛,包括但不限于:

- 自然语言处理:在语言建模、常识推理、长文本理解等任务中表现出色。

- 时间序列预测:在时间序列预测任务中,Titans能够准确地捕捉历史信息,提高预测准确性。

- 基因组学:在基因组学任务中,Titans能够高效地处理长序列数据,为科学研究提供支持。

Titans项目地址

论文标题:Titans: Learning to Memorize at Test Time

论文地址:https://arxiv.org/pdf/2501.00663v1

GitHub 地址:https://github.com/lucidrains/titans-pytorch

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...