Chitu(赤兔)——清华联合清程极智开源的大模型推理引擎

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

主要介绍

Chitu(赤兔)是由清华大学高性能计算研究所翟季冬教授团队与清华系科创企业清程极智联合开源的高性能大模型推理引擎。该引擎旨在解决大模型在推理阶段的高成本和低效率问题,通过底层技术革新,实现了在非英伟达Hopper架构GPU及各类国产芯片上原生运行FP8精度模型,为国产AI芯片的广泛应用和生态建设带来了新的突破。

功能特点

- 多元算力适配:支持英伟达从最新旗舰到旧款的多系列GPU,同时为国产芯片提供深度优化支持,打破了对特定硬件的依赖。

- 全场景可伸缩:从纯CPU部署、单GPU部署到大规模集群部署,赤兔引擎都能提供可扩展的解决方案,满足不同规模和场景下的推理需求。

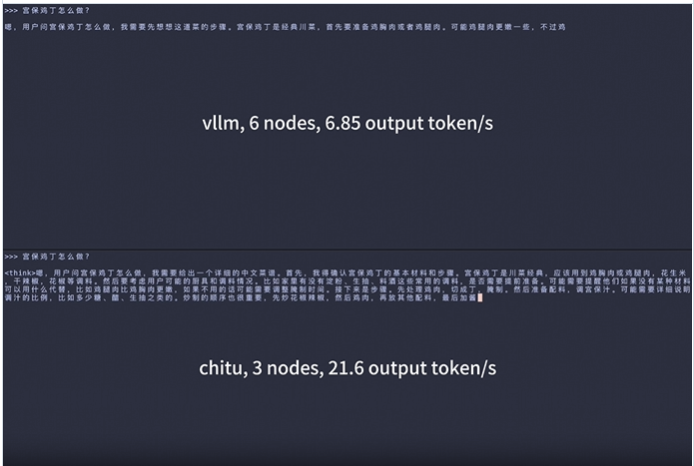

- 高性能优化:通过底层技术革新、算子级优化、全场景性能优化和并行计算与编译优化,显著提升推理效率。在A800集群上部署DeepSeek-R1-671B时,相比部分国外开源框架,GPU使用量减少50%,推理速度提升3.15倍。

- 智能优化技术:赤兔引擎的智能优化技术能够快速适配不同芯片架构,使国产厂商无需重复开发软件,专注于硬件升级。

- 低延迟、高吞吐、小显存优化:针对不同场景,提供低延迟、高吞吐、小显存三套优化方案,让中小型企业用最低成本实现最高性能。

优缺点

优点:

- 打破硬件依赖:首次实现在非英伟达Hopper架构GPU及各类国产芯片上原生运行FP8精度模型,降低了企业部署AI模型的门槛和成本。

- 高性能表现:在GPU使用量减少的情况下,推理速度显著提升,显著提高了性能输出。

- 全场景适配:支持从纯CPU到大规模集群的全场景部署,满足不同规模和场景下的推理需求。

- 智能优化:能够快速适配不同芯片架构,提高开发效率。

缺点:

- 开源时间较短:作为新发布的开源项目,社区支持和文档可能尚不完善,需要一定时间积累。

- 技术门槛:高性能优化和底层技术革新可能要求开发者具备一定的技术背景和实力。

如何使用

-

从源码安装:

- 克隆赤兔引擎的源码仓库:

git clone --recursive https://github.com/thu-pacman/chitu && cd chitu - 安装依赖项:

pip install -r requirements-build.txt - 根据CUDA版本安装PyTorch:

pip install -U torch --index-url https://download.pytorch.org/whl/cu124(注意调整CUDA版本) - 安装赤兔引擎:

TORCH_CUDA_ARCH_LIST=8.6 CHITU_SETUP_JOBS=4 MAX_JOBS=4 pip install --no-build-isolation .

- 克隆赤兔引擎的源码仓库:

-

运行推理:

- 单GPU推理:

torchrun --nproc_per_node 8 test/single_req_test.py request.max_new_tokens=64 models=DeepSeek-R1 models.ckpt_dir=/data/DeepSeek-R1 infer.pp_size=1 infer.tp_size=8 - 混合并行推理(TP+PP):

torchrun --nnodes 2 --nproc_per_node 8 test/single_req_test.py request.max_new_tokens=64 infer.pp_size=2 infer.tp_size=8 models=DeepSeek-R1 models.ckpt_dir=/data/DeepSeek-R1 - 启动服务:在

localhost:21002启动服务,并测试服务。

- 单GPU推理:

框架结构

赤兔引擎的框架结构主要包括以下几个部分:

- 前端接口:提供用户友好的接口,支持多种模型格式和输入方式。

- 算子库:包含各种优化后的算子实现,支持FP8精度模型的原生运行。

- 调度器:负责任务的调度和分配,优化资源利用率。

- 后端执行引擎:支持多种硬件架构,实现高效的推理计算。

- 优化器:针对不同场景和硬件架构,提供智能优化方案。

创新点

- 底层技术革新:通过底层架构革新,首次实现了非英伟达Hopper架构GPU及各类国产芯片对原生FP8模型的高效部署。

- 算子级优化:对关键算子进行了指令级优化,直接处理FP8数据而非简单量化,确保了模型精度无损的同时显著提升了推理速度。

- 全场景性能优化:支持低延迟、高吞吐和小显存优化,能根据不同场景需求提供最优解决方案。

- 混合精度调度算法:独创的混合精度调度算法,让不同架构芯片都能发挥最大潜能。

评估标准

评估赤兔引擎的标准可以包括以下几个方面:

- 性能表现:推理速度、GPU使用量、延迟等指标。

- 兼容性:支持的硬件架构、模型格式等。

- 易用性:安装、配置、使用的便捷程度。

- 稳定性:在实际生产环境中的运行稳定性。

- 社区支持:文档完善程度、社区活跃度等。

应用领域

赤兔引擎可广泛应用于需要高效大模型推理的各个领域,如金融、医疗、智能客服、自动驾驶等。通过降低部署门槛和成本,赤兔引擎将推动这些领域的人工智能应用更快落地。

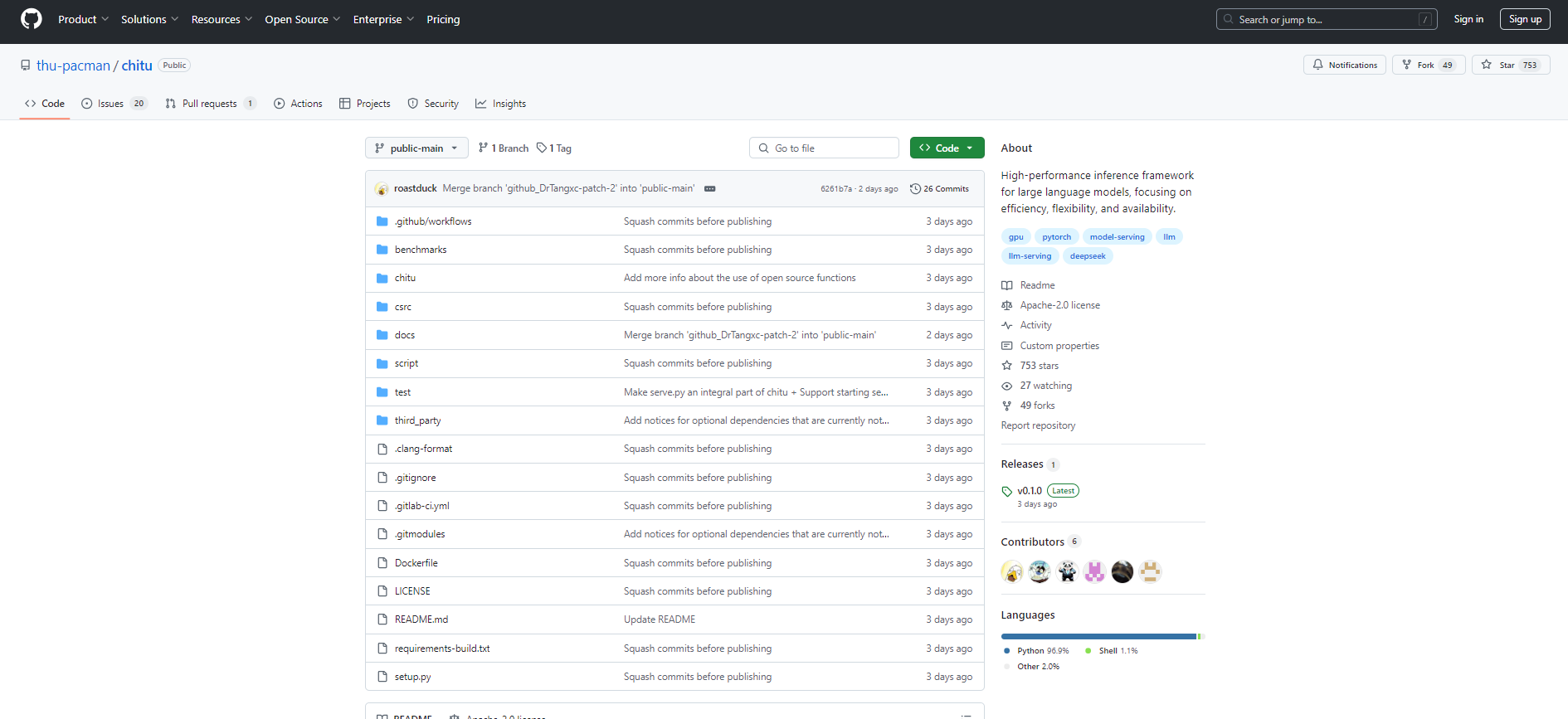

项目地址

赤兔引擎的开源项目地址为:https://github.com/thu-pacman/chitu

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...