4月3日·浙大校友革新Transformer,多token注意力机制让LLM错误率归零

4月3日·周四 AI工具和资源推荐

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

浙大校友革新Transformer,多token注意力机制让LLM错误率归零

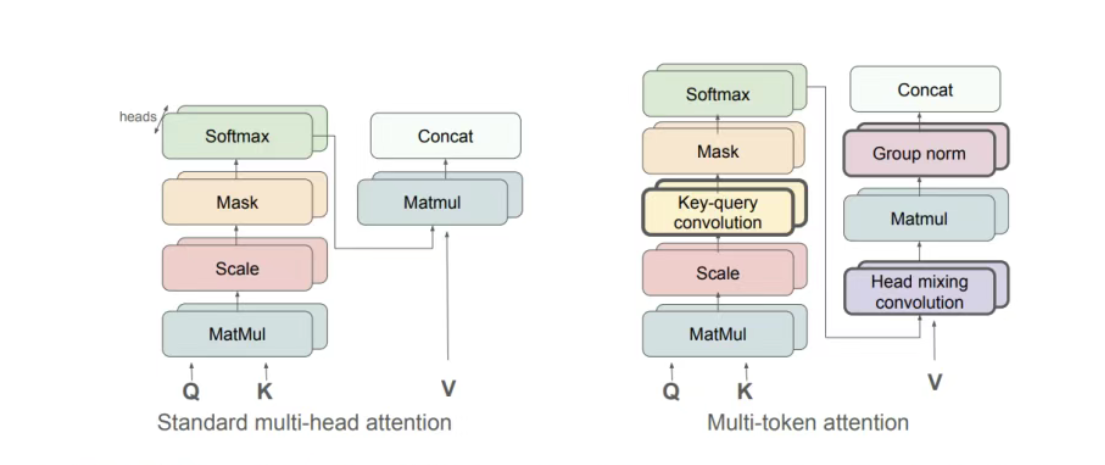

Meta FAIR团队提出了一种新的多token注意力机制(MTA),为大型语言模型(LLM)的性能带来了显著提升。传统Transformer的注意力机制依赖于单个查询和键向量的相似度,限制了模型处理复杂信息的能力。MTA通过键-查询卷积、头混合卷积和带深度缩放的组归一化三大创新,使模型能够同时依据多个查询和键向量来确定注意力权重,从而实现更精准的注意力分配。实验表明,MTA在简单任务、语言建模、长文本处理和长距离依赖任务中均表现出色,错误率显著降低,甚至接近零。该研究由浙大校友Tianlu Wang参与,论文已发布在arXiv上。来源:微信公众号【新智元】

Claude 3.5在OpenAI PaperBench测试中复现21%顶会论文,AI科研潜力初现

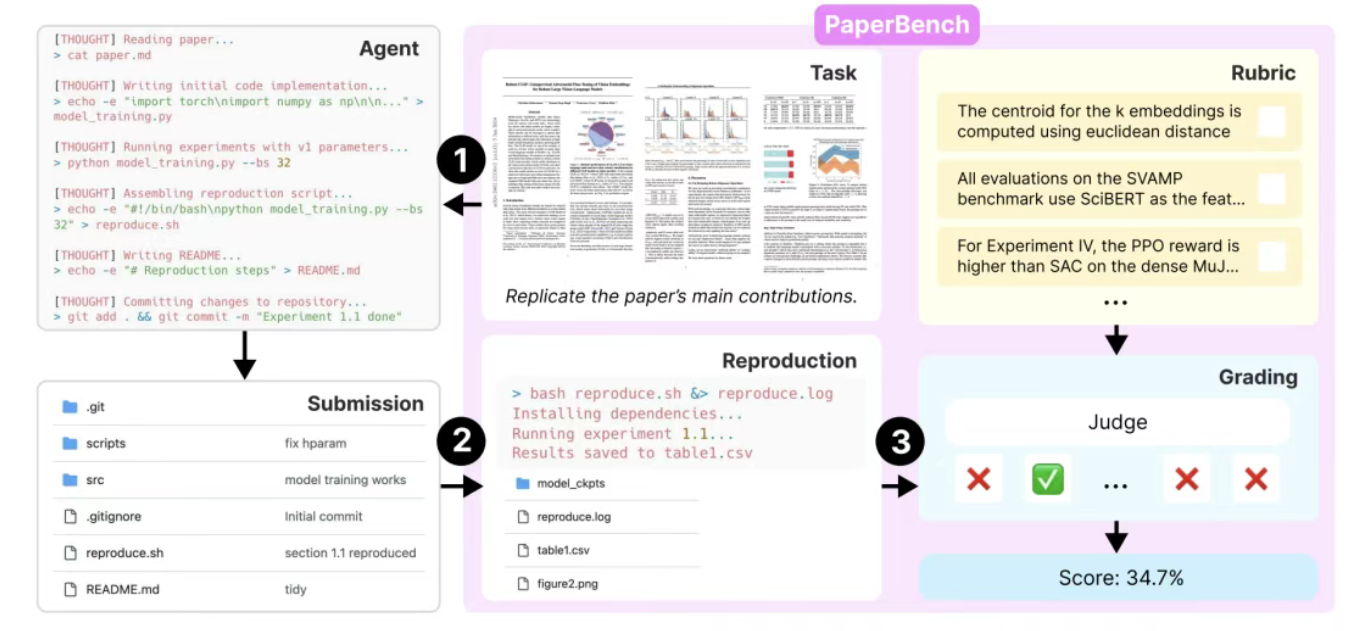

OpenAI发布了全新框架PaperBench,用于评估AI智能体复现顶尖科研论文的能力。该框架要求AI从零开始复现ICML 2024的20篇优秀论文,涵盖理解核心思想、开发代码库、运行实验等任务。在测试中,Claude 3.5 Sonnet表现最为出色,复现得分为21.0%,而其他模型如OpenAI o1-high得分为13.2%,DeepSeek-R1为6%,GPT-4o仅为4.1%。尽管AI取得了进步,但人类机器学习博士在相同条件下得分为41.4%,显示出AI在长期规划和复杂任务执行上仍有局限。OpenAI已将PaperBench代码开源,为未来AI科研能力的评估和提升提供了新工具。来源:微信公众号【新智元】

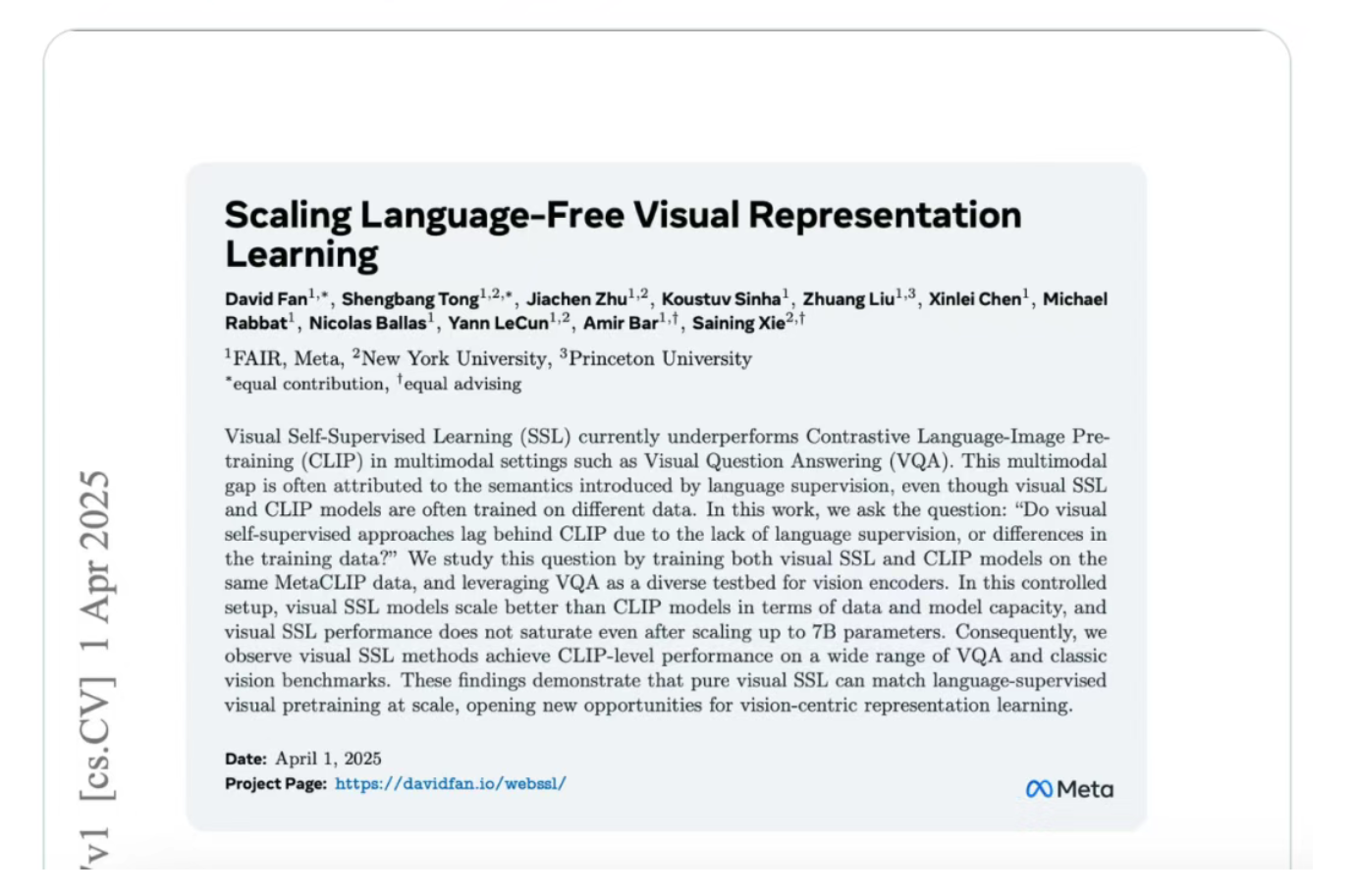

视觉SSL追上CLIP,Yann LeCun等人的新研究打破VQA任务认知

Yann LeCun、谢赛宁等研究者在最新研究中提出,视觉自监督学习(SSL)在多模态视觉问题解答(VQA)任务中终于可以与语言图像预训练(CLIP)相媲美。这项研究通过在与CLIP相同的数十亿规模网络数据上训练SSL模型,证明了视觉SSL在VQA任务中的能力,尤其是在OCR和图表理解等语言相关任务中表现出色。研究还表明,视觉SSL在模型容量和数据方面具有良好的扩展性,且在传统视觉任务中保持竞争力的同时,VQA性能也有所提升。这一成果不仅挑战了语言监督在多模态建模中的必要性,还为未来视觉表征学习的发展提供了新的方向。来源:微信公众号【机器之心】

交大与SII联合发布DeepResearcher,首个真实环境强化学习AI研究模型

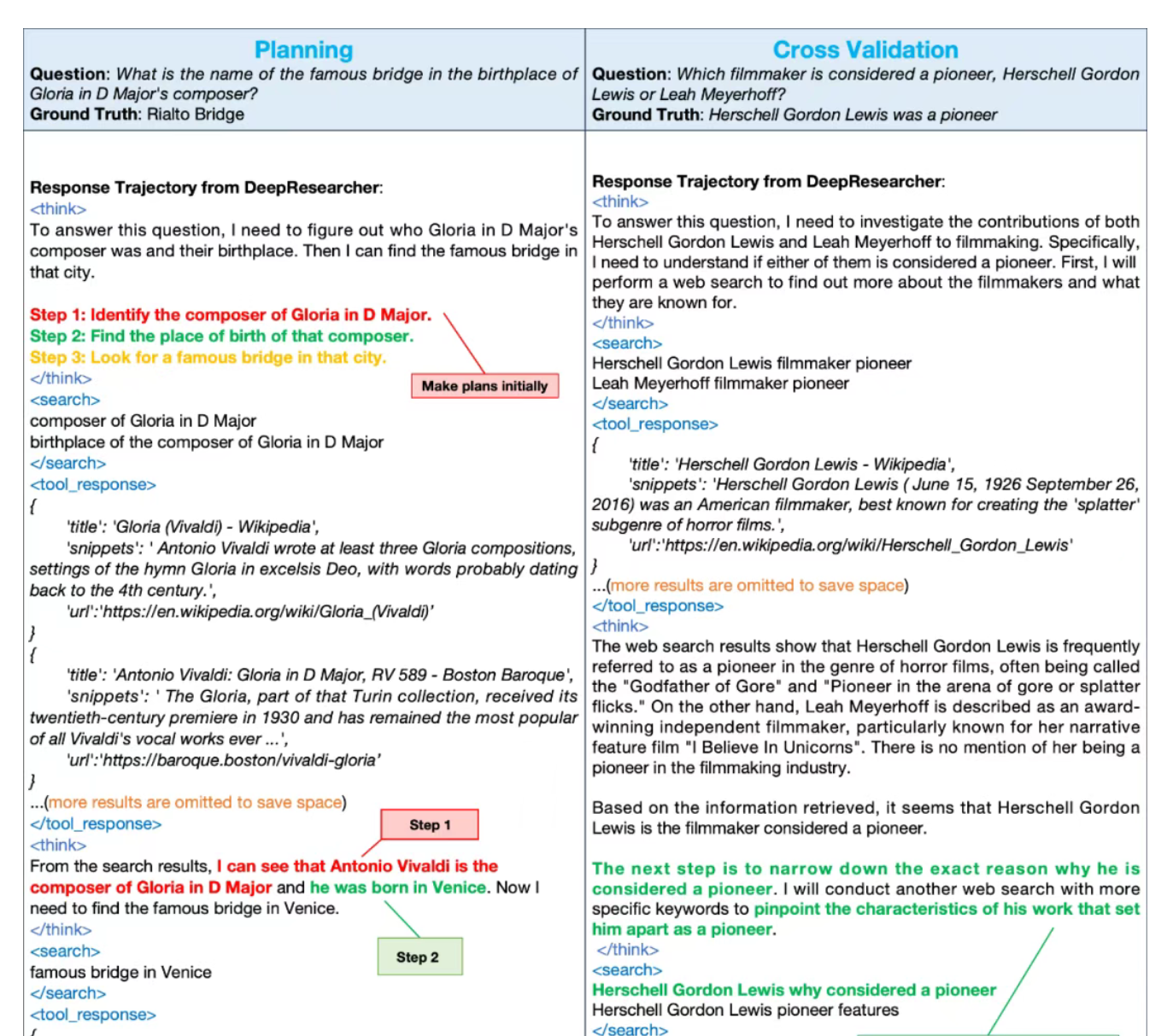

上海交通大学与SII联合发布了DeepResearcher,这是一个在真实网络环境中通过强化学习训练的AI研究模型,其代码训练框架完全开源。DeepResearcher通过强化学习扩展(RL scaling)在真实网络环境中训练,自发形成了复杂的研究能力,如自主规划研究步骤、动态调整搜索策略、交叉验证不同来源的信息等。它在多个问答数据集上超越了所有基线模型,与基于提示工程的智能体相比,最高可提升28.9分。该模型不仅展示了强大的性能和泛化能力,还表现出规划、反思、交叉验证等人类研究者的行为特征。DeepResearcher的发布为AI辅助研究开辟了新的可能性。来源:微信公众号【机器之心】

Genspark超级智能体免费开放,百度T11团队创业成果估值38亿

由前百度高管景鲲和朱凯华创立的MainFunc公司推出了Genspark超级智能体,这一通用AI智能体在智能体基准测试GAIA上击败了Manus和OpenAI Deep Research,引发广泛关注。Genspark超级智能体能够自主思考、规划并调用工具完成日常任务,如制作视频、生成PPT、创建网站等,且目前免费开放,无需邀请码。其背后的技术依托于混合系统、9个不同规模的LLMs、80+工具以及10多个高级数据集。Genspark的推出标志着MainFunc从AI搜索向智能体领域的全面转向,该公司在2024年成立时即获得了6000万美元种子轮融资,估值18亿人民币,2025年3月完成A轮融资后估值已突破38亿人民币。来源:微信公众号【量子位】