Qwen3-Omni : 阿里通义开源的原生端到端全模态大模型

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

主要介绍

Qwen3-Omni是阿里巴巴旗下Qwen团队发布的业界首个原生端到端全模态AI模型,能够在一个统一的模型框架内无缝处理文本、图像、音频和视频四种核心模态信息。该模型通过原生多模态设计,解决了传统多模态模型需在不同能力间权衡取舍的难题,实现了跨模态性能与单模态效果的双重突破。作为开源模型,Qwen3-Omni推动了多模态AI技术从“技术拼图”向“一体化融合”的跨越,为全球开发者提供了强大的基础工具。

功能特点

- 全模态处理能力:原生支持文本、图像、音频、视频输入,并实时生成文本或语音输出。

- 跨模态性能领先:在36项音频/视频基准测试中,22项达到业界顶尖水平(SOTA),32项在开源领域领先,自动语音识别(ASR)、音频理解与语音对话性能媲美Gemini 2.5 Pro。

- 多语言支持:覆盖119种文本语言、19种语音输入语言(如英语、中文、粤语、阿拉伯语等)及10种语音输出语言(如英语、中文、法语、德语等)。

- 低延迟交互:音频对话延迟低至211毫秒,视频对话延迟507毫秒,支持长达30分钟的音频理解。

- 实时流式输出:通过文本与自然语音实时响应,支持自然对话的流畅进行。

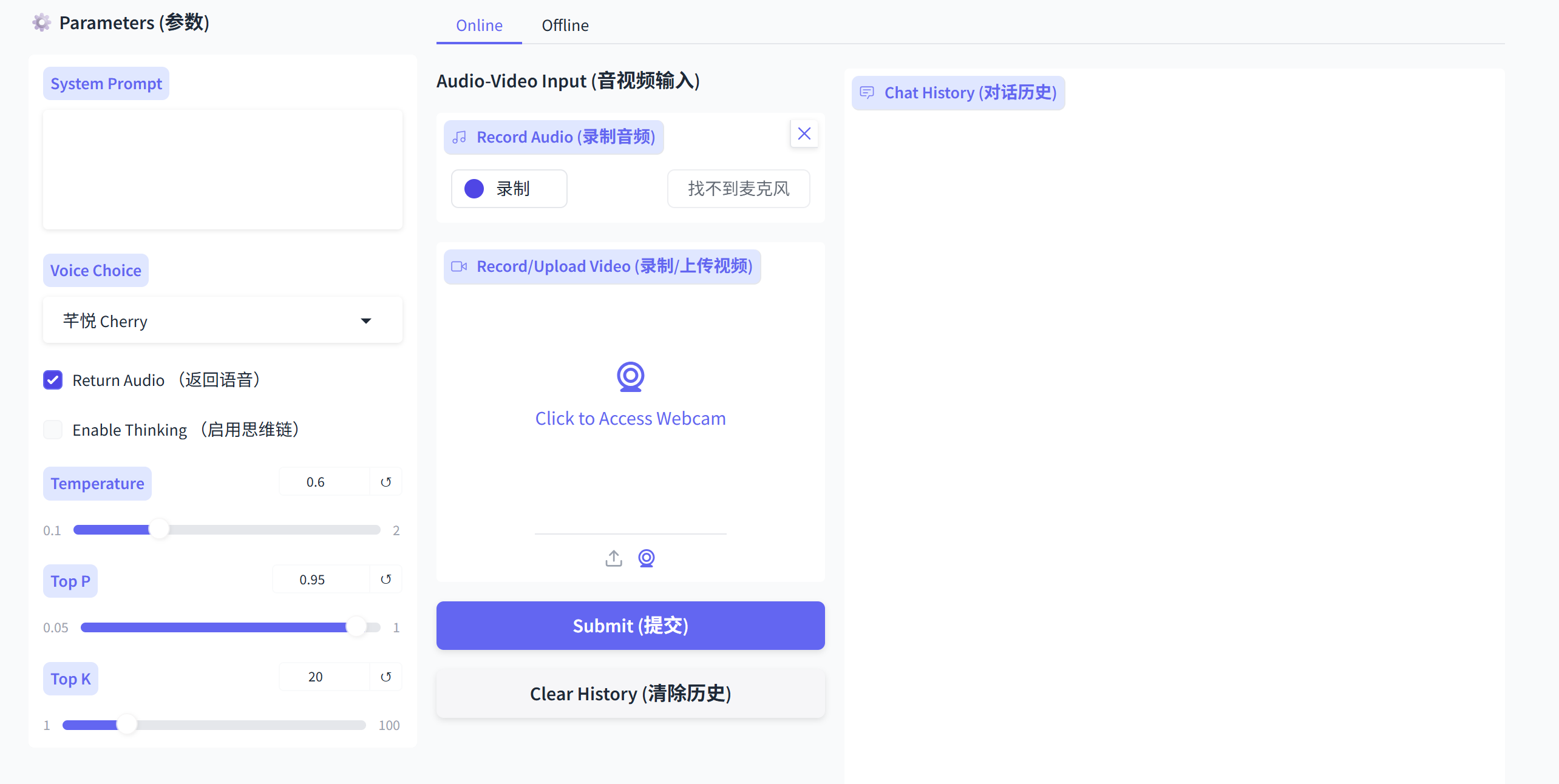

- 灵活控制与适配:支持系统提示词自定义行为,满足个性化需求,并内置工具调用功能,方便与其他应用集成。

优缺点

优点:

- 一体化融合:突破传统多模态模型的结构限制,实现跨模态与单模态性能的平衡。

- 性能卓越:在多项基准测试中表现优异,尤其擅长音频、视频处理及多语言任务。

- 开源生态:提供多个开源版本(如Qwen3-Omni-30B-A3B-Instruct),赋能全球开发者探索多样化应用场景。

缺点:

- 训练数据时效性:模型训练数据截止到2024年,暂不支持实时联网更新,对最新信息的处理能力有限。

- 复杂场景适配:在极端垂直领域(如高精度医学影像分析)中,可能需要进一步微调以优化性能。

如何使用

- 网页端体验:访问Qwen3-Omni官方Demo,上传文本、图像、音频或视频文件,模型将实时生成响应结果。

- API调用:通过阿里云百炼平台开通Qwen3-Omni服务,获取API Key后,使用HTTP请求发送多模态输入数据(如图片URL、音频文件),获取生成的文本或语音输出。

- 移动端应用:部分合作伙伴应用已集成Qwen3-Omni能力,用户可直接通过语音或图像交互完成任务(如语音助手、图像搜索等)。

框架技术原理

- 混合专家(MoE)架构:模型总参数达300亿,但每次推理仅激活30亿参数,显著提升运行效率。

- “思考者-表达者”机制:

- 思考者(Thinker):深度理解多模态输入,生成高层次语义表征。

- 表达者(Talker):将语义实时解码为文本或自然语音,支持流式输出。

- 多码本设计:降低延迟,确保实时音频/视频交互的流畅性。

- AuT预训练:结合大规模多模态数据预训练,增强模型的通用表征能力。

创新点

- 原生端到端设计:首次实现文本、图像、音频、视频在单一模型中的统一处理,无需模块拼接。

- 跨模态映射能力:将不同语言和模态映射到同一语义空间,提升模型对上下文建模和语义对齐的能力。

- 低延迟与高效率:通过MoE架构和多码本设计,平衡模型性能与计算资源消耗。

- 开源协同理念:开源多个模型版本,推动全球开发者在指令遵循、创意任务等领域探索创新应用。

评估标准

- 基准测试性能:在36项音频/视频基准测试中,对比词错误率(WER)、情感识别准确率等指标。

- 多语言支持广度:评估模型对119种文本语言、19种语音输入语言及10种语音输出语言的覆盖能力。

- 延迟与效率:测量音频/视频对话的首包延迟、满并发延迟及实时处理能力。

- 用户主观评价:通过人工评估模型的语音自然度、情感表达力及跨模态理解准确性。

应用领域

- 数字人与虚拟客服:理解用户视频表情与语音语调,生成情感共鸣的文本/语音回复。

- 电商与广告:支持多图融合编辑(如“在线试穿”“虚拟家装”),提升商品展示的个性化与沉浸感。

- 游戏与元宇宙:构建理解玩家语音指令和游戏画面的高级AI NPC,增强交互体验。

- 智能教育:实时解析教学内容中的文本、图像与音频,提供个性化学习辅导。

- 媒体与娱乐:快速生成多模态内容(如视频字幕、语音配音),降低创作门槛。

项目地址

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...