聆音EchoCare : 香港中科院推出的超声大模型

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

主要介绍

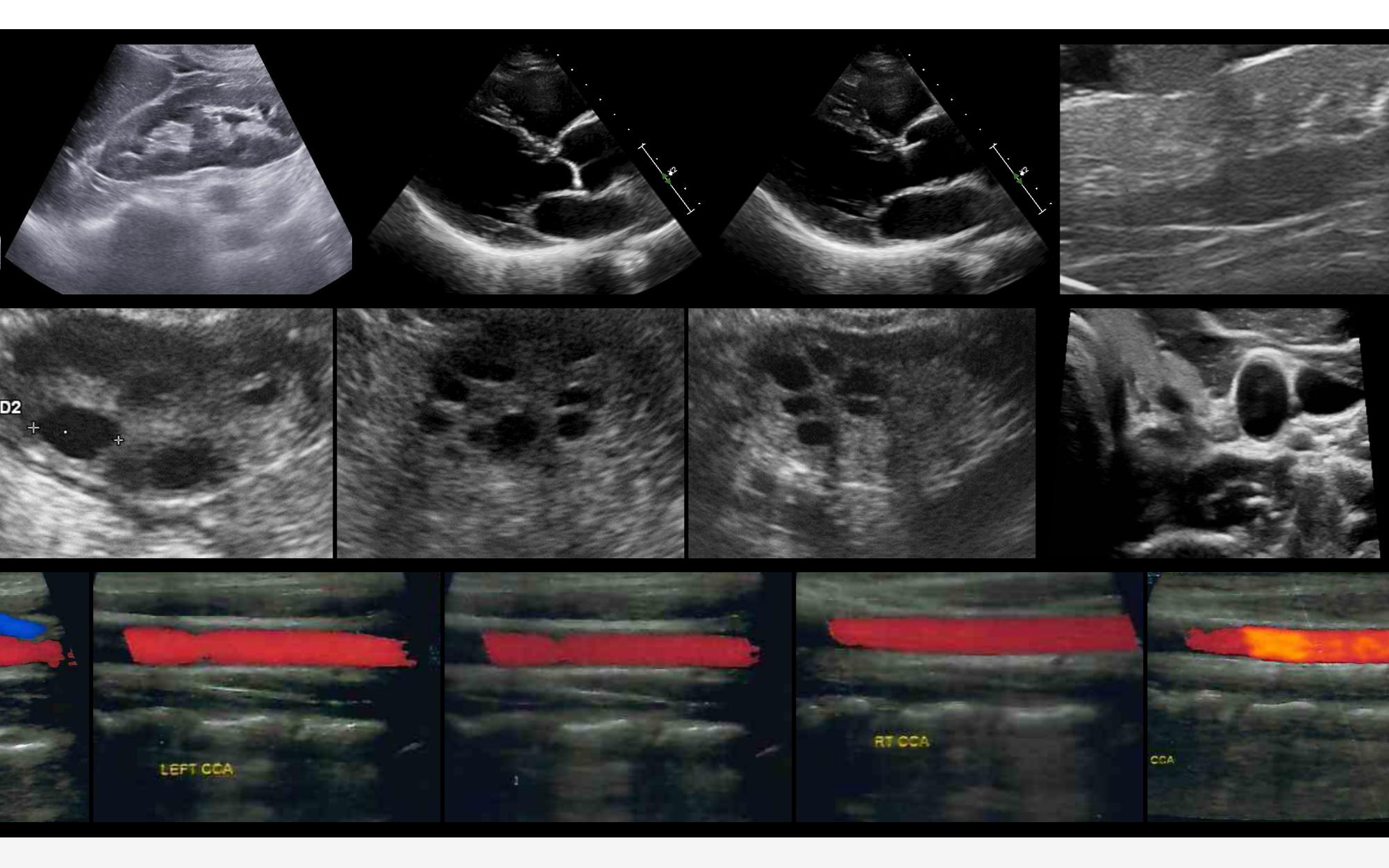

聆音EchoCare是由中国科学院香港创新研究院人工智能与机器人创新中心(CAIR)研发的超声基座大模型,于2025年9月17日正式开源发布。该模型基于全球已知规模最大的超声影像数据集(超过450万张图像,涵盖50多个人体器官)训练而成,旨在解决传统超声AI模型对大规模标注数据的依赖、长尾分布处理困难、泛化性不足及医学知识嵌入困难等问题。通过首创的结构化对比自监督学习框架和层级化双分支架构,聆音在器官识别、分割、病灶分类等10余项超声医学任务中性能全面登顶,为超声AI的规模化应用和临床落地提供了创新解决方案。

功能特点

- 多任务高性能:在器官识别、分割、病灶分类、关键点检测、切面识别等10余项任务中表现卓越,性能平均优于当前最优方法(SOTA)3%-5%。

- 数据高效性:采用自监督学习框架,减少对专家标注的依赖,标注效率提升40%-60%,收敛速度加快30%-40%。

- 临床适配性:单张图像分析时间小于0.5秒,支持实时诊断;输出分割掩码、热力图等可视化结果,并可自动生成诊断报告(BLEU-4评分达78.47)。

- 泛化能力强:覆盖多中心、多设备、多人种、多器官的数据集(涵盖五大洲20个国家、130种超声设备),模型鲁棒性显著提升。

优缺点

- 优点:

- 数据规模全球领先,覆盖多样性高,解决传统模型数据壁垒问题。

- 结构化对比自监督学习框架创新性强,实现像素与语义特征协同学习。

- 临床回溯性验证充分,在卵巢癌、甲状腺结节等场景中灵敏度、特异度显著优于现有模型。

- 缺点:

- 多模态信息融合不足,未来需扩展至图文等多模态数据。

- 动态序列处理能力薄弱,对超声视频等时序数据的分析能力需提升。

- 临床落地需深化,需通过更多中心试验建立性能监测体系。

如何使用

- 临床诊断辅助:医院可接入聆音API,在超声检查中实时获取器官分割、病灶分类结果,辅助医生快速决策。例如,在卵巢癌筛查中,模型可自动标记可疑肿瘤并生成初步诊断报告。

- 基层医疗赋能:通过云端部署,基层医院无需高端设备即可利用聆音进行标准化的超声分析,缓解超声医生短缺问题。

- 科研与教育:研究机构可基于开源模型和数据集开发定制化算法;医学院可利用其可视化结果(如热力图)进行教学演示。

框架技术原理

- 数据层:构建全球最大超声影像数据集EchoAtlas(453万张图像),涵盖多中心、多设备、多人种数据,通过四阶段质控体系确保数据质量。

- 架构层:

- 图像编码器:以SwinTransformer为骨干,优化注意力机制增强边缘特征鲁棒性,应对超声斑点噪声。

- 双分支解码器:图像重建分支学习像素级特征;解剖分类分支引入三级分类头,模拟医师“区域-器官”诊断思维。

- 训练范式:

- 全局预训练:首创结构化对比自监督学习框架,基于医学先验的层次化树形标签实现多标签语义关系隐式编码。

- 下游微调:分割任务结合预训练编码器与解码器;诊断任务使用分类头;量化任务添加回归头,微调数据量减少40%-60%。

创新点

- 数据创新:构建全球最大超声预训练数据集,打破数据壁垒。

- 架构创新:设计层级化双分支架构,贴合临床诊断逻辑,实现“看懂图像”与“理解结构”的统一。

- 训练范式创新:首创结构化对比自监督学习框架,无需大量标注数据即可实现特征学习与下游任务解耦。

评估标准

- 性能指标:在器官分割(如mDSC指标)、病灶分类(如AUC、F1分数)、量化任务(如误差率)等任务中对比SOTA模型。

- 临床价值:通过多中心回溯性验证(如山东大学齐鲁医院1556例卵巢病例、中南大学湘雅医院1000例甲状腺病例)评估诊断灵敏度、特异度及假阳性率。

- 效率指标:标注效率(如用60%标注数据达到传统模型100%性能)、收敛速度(如训练时间缩短30%-40%)、单图分析时间(<0.5秒)。

应用领域

- 医院常规检查:辅助医生进行快速、精准的超声诊断,降低漏诊率。

- 疾病筛查:在卵巢癌、甲状腺结节、乳腺癌等场景中实现早期发现。

- 心脏超声检测:支持主动脉瘤检测、左心室射血分数计算等任务。

- 基层医疗:通过标准化分析提升边远地区诊断水平。

项目地址

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...