LingBot-Map : 蚂蚁灵波开源的流式 3D 重建模型

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

主要介绍

LingBot-Map 是蚂蚁灵波科技于 2026 年 4 月开源的流式三维重建模型,专为实时空间感知设计。该模型仅需单颗普通 RGB 摄像头,即可在视频采集过程中同步完成相机位姿估计与场景三维结构重建,填补了实时三维重建领域的技术空白。其核心目标是为机器人导航、自动驾驶、AR/VR 等场景提供高精度、低延迟的空间理解能力,推动具身智能技术的普适化应用。

功能特点

- 实时流式重建:支持边采集视频边重建,无需等待完整数据输入。

- 单摄像头输入:仅需普通 RGB 摄像头,无需激光雷达或深度相机等昂贵硬件。

- 高精度与稳定性:在 Oxford Spires 数据集上绝对轨迹误差(ATE)仅 6.42 米,较前最优流式方法提升 2.8 倍;ETH3D 基准重建 F1 分数达 85.70,较第二名提升超 8%。

- 长序列处理能力:支持超 10,000 帧连续视频推理,精度几乎无衰减。

- 轻量化部署:推理速度约 20 FPS,显存占用仅 13.28GB,可在消费级显卡上运行。

优缺点

- 优点:

- 硬件成本低:单摄像头方案显著降低部署门槛,适合消费级机器人和低成本自动化设备。

- 实时性强:20 FPS 推理速度满足动态场景需求,如机器人避障、交互等。

- 精度领先:在多个权威基准测试中超越同类流式模型,甚至优于部分离线方法。

- 缺点:

- 极端场景鲁棒性待验证:实验室数据与真实产线环境存在差距,需更多应用案例验证弱纹理、光照剧烈变化等场景的适应性。

- 模型可解释性挑战:基于学习的方法依赖大规模数据,长尾场景泛化能力需进一步优化。

如何使用

- 访问项目地址:从 Hugging Face 或 ModelScope 下载预训练模型权重及技术文档。

- 准备输入数据:使用普通 RGB 摄像头采集视频,或提供现有视频文件(如 MP4 格式)。

- 运行推理:

- 离线模式:输入视频文件,模型逐帧处理并输出相机轨迹和深度图,最终融合为三维点云。

- 实时模式:连接摄像头,设置分辨率(如 640×480 或 1280×720),模型以 20 FPS 实时输出当前相机位姿及场景三维结构。

- 查看结果:通过可视化脚本生成三维点云地图,支持交互式查看相机轨迹与场景细节。

框架技术原理

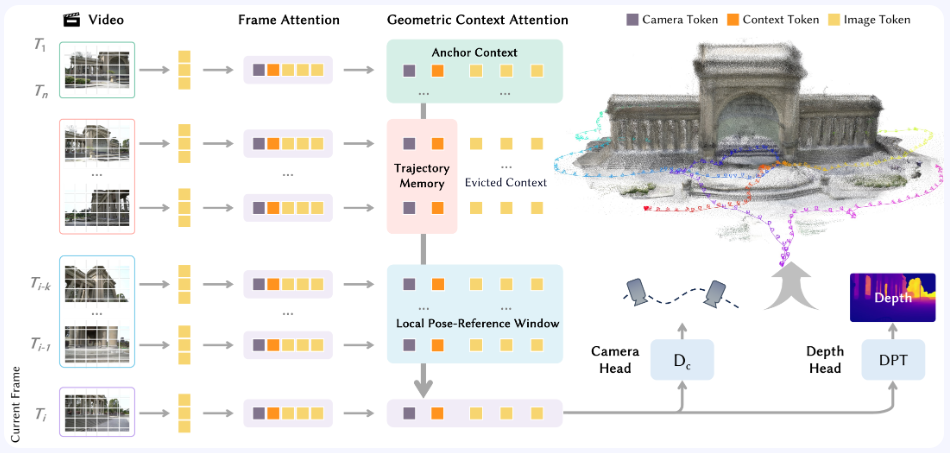

- 纯自回归式建模:基于几何上下文 Transformer(GCT),逐帧处理当前及历史画面,不依赖未来帧信息,实现“所见即所建”。

- 几何上下文注意力机制(GCA):

- 分层记忆管理:通过锚点(Anchor)、位姿参考窗口(Pose-reference Window)、轨迹记忆(Trajectory Memory)三类记忆组织跨帧几何信息。

- 高效计算:借鉴经典 SLAM 分层管理思路,但将核心逻辑交由模型统一学习,减少冗余计算,兼顾精度与效率。

- 训练策略:采用渐进式视图训练,从短子序列(24 帧)逐步扩展至长序列(320 帧),使用深度损失、绝对位姿损失与相对位姿损失组成的复合损失函数优化模型。

创新点

- 几何上下文注意力机制(GCA):首次将分层记忆管理引入流式重建,解决长序列灾难性遗忘和内存膨胀问题。

- 单摄像头实时重建:突破传统方法对多传感器或离线处理的依赖,实现轻量化部署。

- 数据驱动替代手工设计:将位姿图优化、闭环检测等模块统一为模型学习任务,提升泛化能力。

评估标准

- 精度:通过绝对轨迹误差(ATE)、重建 F1 分数等指标衡量位姿估计与三维重建质量。

- 效率:以推理速度(FPS)和显存占用评估实时性与硬件友好性。

- 稳定性:在超万帧长视频中测试精度衰减情况,验证长序列处理能力。

应用领域

- 机器人导航:实时构建环境地图,支持避障、路径规划等任务。

- 自动驾驶:动态感知周围场景,提升定位与决策准确性。

- AR/VR:根据用户视角实时生成三维场景,增强沉浸感。

- 工业检测:在产线中监测设备状态,识别异常结构变化。

项目地址

- 项目官网:https://technology.robbyant.com/lingbot-map

- GitHub 仓库:https://github.com/Robbyant/lingbot-map

- Hugging Face 模型库:https://huggingface.co/robbyant/lingbot-map

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...