Hunyuan-Large —— 腾讯推出的大型混合专家(MoE)模型

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

Hunyuan-Large的主要介绍

Hunyuan-Large是腾讯推出的一款大型混合专家(MoE)模型,具有3890亿总参数和520亿激活参数,是业界参数规模最大的开源MoE模型。它基于Transformer架构,支持超长文本输入,显著提升了长上下文任务的处理能力。

Hunyuan-Large的功能特点

- 长上下文处理能力:预训练模型支持高达256K的文本序列输入,显著增强了处理长上下文任务的能力。

- 高质量文本创作:能生成高质量的文章、写作、润色、总结和创意文本,适用于多种写作场景。

- 知识问答:具备广泛的知识理解能力,能回答用户的各种知识性问题,提供准确的信息和解释。

- 多轮对话:支持流畅的多轮对话,能与用户进行自然的交流,理解上下文给出恰当的回答。

- 数学逻辑和代码创作:在数学逻辑和编程代码的生成和理解方面表现出色,能协助用户解决数学问题和编写代码。

Hunyuan-Large的优缺点

优点:

- 强大的参数规模:Hunyuan-Large拥有3890亿总参数和520亿激活参数,是业界参数规模最大的开源MoE模型。

- 卓越的处理能力:支持超长文本输入,显著提升了长上下文任务的处理能力。

- 广泛的应用场景:适用于文本生成、对话系统、情感分析、机器翻译等多个领域。

缺点:

- 计算成本高:由于参数规模庞大,训练和推理过程中可能需要较高的计算成本。

- 部署难度高:对于普通用户来说,部署和使用如此大规模的模型可能存在一定的难度。

如何使用Hunyuan-Large

腾讯在Hugging Face平台上开源了Hunyuan-A52B-Pretrain、Hunyuan-A52B-Instruct以及Hunyuan-A52B-Instruct-FP8,并发布了技术报告和训练推理操作手册,详细介绍了模型能力和训练与推理的操作。用户可以通过访问这些资源来了解如何使用Hunyuan-Large。

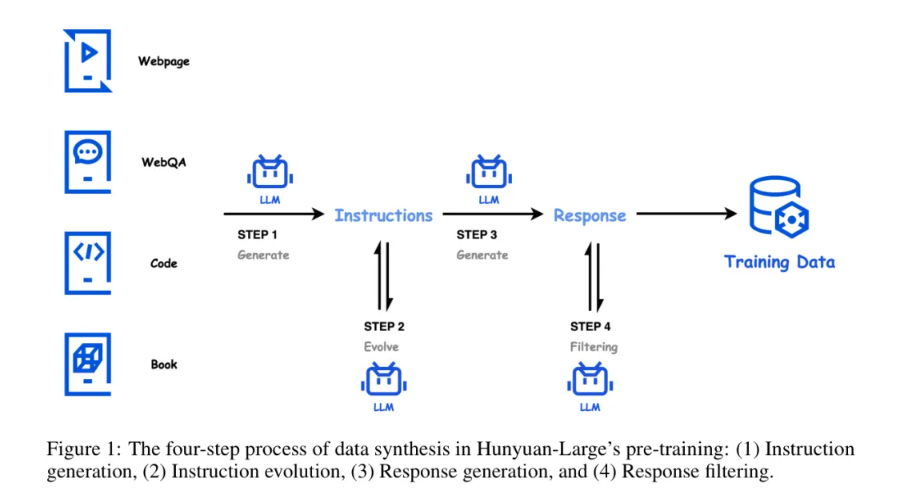

Hunyuan-Large的训练方法

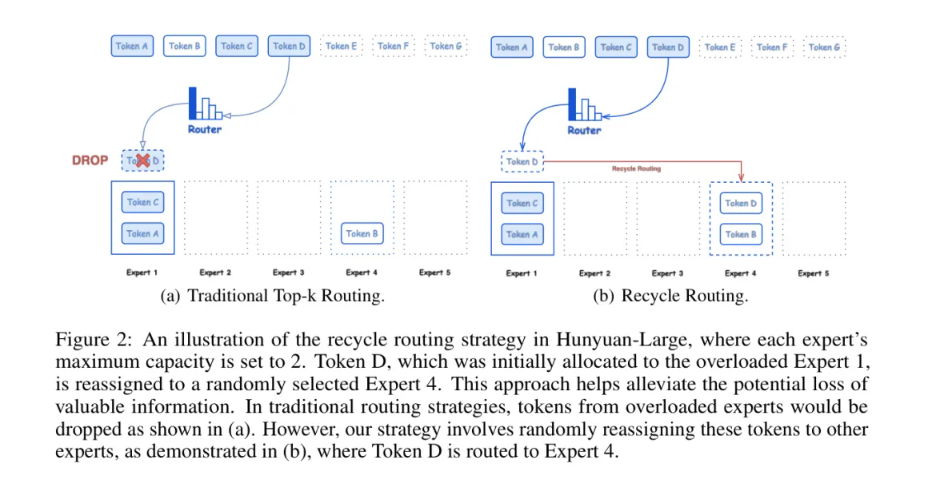

Hunyuan-Large的训练方法涉及多个方面,包括高质量的合成数据增强训练、分组查询注意力(GQA)和跨层注意力(CLA)策略以减少KV缓存的内存占用和计算开销、专家特定学习率缩放以确保每个子模型都能有效地从数据中学习等。此外,腾讯还采用了随机补偿的路由方式,以提升模型的训练稳定性和收敛速度。

Hunyuan-Large的框架结构

Hunyuan-Large是基于Transformer架构的MoE模型,具有庞大的参数规模和灵活的混合专家机制。它能够通过激活模型中的特定参数子集来处理大规模文本,从而提高计算效率和响应速度。

Hunyuan-Large的创新点

- 高质量的合成数据:通过合成数据增强训练,使模型能够学习到更丰富的表示,适应处理更长的上下文输入。

- KV缓存压缩:采用分组查询注意力(GQA)和跨层注意力(CLA)策略,显著降低了KV缓存的内存占用和计算开销。

- 专家特定学习率缩放:为不同专家设置不同的学习率,以确保每个子模型都能有效地从数据中学习并为整体性能做出贡献。

Hunyuan-Large的评估标准

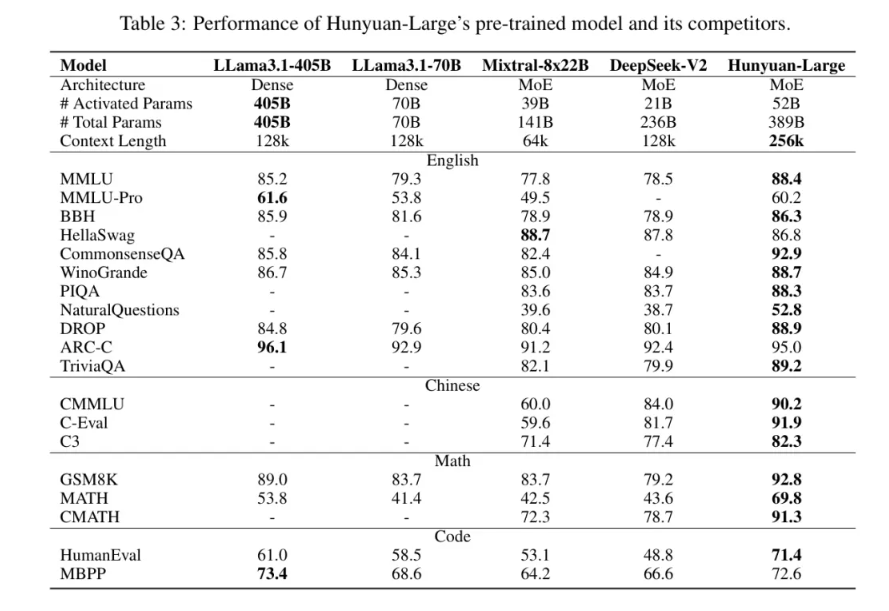

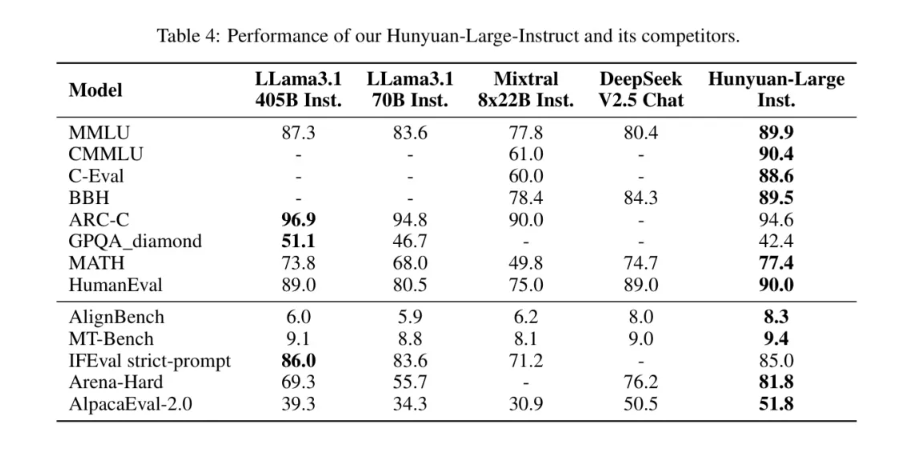

Hunyuan-Large在多种语言和任务上进行了广泛的基准测试,以验证其实用有效性和安全性。这些测试包括MMLU、MMLU-Pro、CMMLU等多学科综合评测集,以及中英文自然语言处理、代码生成、数学运算等9大能力维度的评估。

Hunyuan-Large的应用领域

Hunyuan-Large广泛适用于商业、教育和创意写作等多个领域。例如,在商业广告中,企业可以利用Hunyuan-Large的自然语言处理能力快速生成符合品牌定位的文案,并借助AI绘画工具生成视觉内容,实现文本与图像的完美结合。

Hunyuan-Large的影响

Hunyuan-Large的推出不仅标志着腾讯在人工智能技术研发领域的不断突破,也为研究人员和开发者提供了更强大的工具和支持。它推动了自然语言处理领域的发展,并为AI绘画和AI写作等领域的发展带来了新的机遇。