11月16日· Nature研究揭示LLM在理解人类语言上的局限

11月16日·周六 AI工具和资源推荐

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的o g zAI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

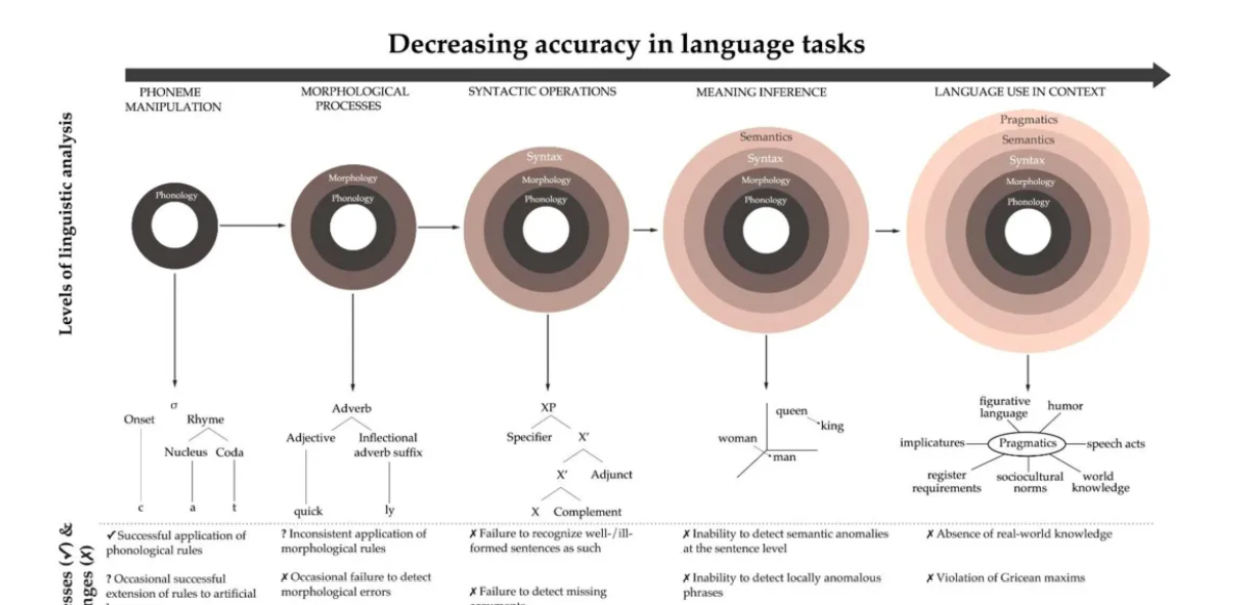

Nature研究揭示LLM在理解人类语言上的局限

最新Nature杂志上的研究显示,尽管大型语言模型(LLM)在多项任务中表现出色,但在理解人类语言方面仍存在显著局限。研究者通过“人类亲吻难题”测试了包括GPT-4在内的7个先进模型,发现LLM在理解和推理能力上远未达到人类水平。这些模型在回答理解性问题时准确性和稳定性均低于人类,表明LLM更像是工具而非具有类人推理能力的理论。研究强调,LLM的成功不应被误解为掌握了完成任务所需的一般知识,而是应被视为在特定任务中的有效工具。来源:微信公众号【新智元】

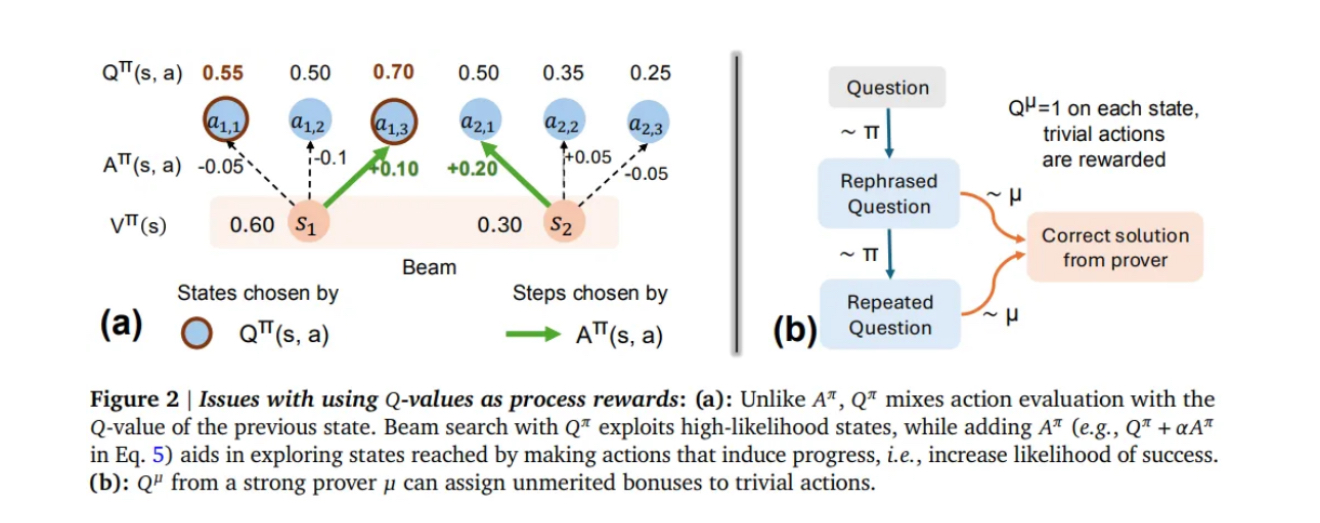

谷歌DeepMind新研究提升LLM数学推理能力

谷歌DeepMind与卡内基梅隆大学的研究人员合作,提出了一种新的过程奖励模型(PRM)和过程优势验证器(PAV),在每一步提供反馈,优化基础策略,显著提升了大型语言模型(LLM)在数学推理方面的能力。这项研究通过预测模型在生成正确回复概率的变化,改善了测试时搜索和在线强化学习期间的探索,使得搜索准确率提升了8%,计算效率提升了1.5到5倍。研究还表明,使用PAV的密集奖励在样本效率上提升了5-6倍,比传统的结果奖励模型(ORM)的准确率提升了6%。这项工作不仅提高了LLM的准确性和计算效率,也为解决复杂问题提供了新的思路。来源:微信公众号【新智元】

NEO AI工程师在Kaggle竞赛中超越OpenAI o1

NEO,一家创业公司开发的AI工程师,最近在AI领域引起了轰动。这个完全自动化的机器学习AI工程师在50个Kaggle竞赛中获得了26%的奖牌,表现优于OpenAI的o1模型。NEO能够自动化整个机器学习工作流程,为开发人员节省数千小时的繁重工作。作为一个多智能体系统,NEO通过并行处理解决单一问题,简化了从数据准备到模型部署的复杂环节。NEO的目标不是取代数据科学家或工程师,而是与人类合作,处理所有繁重任务,使得原本需要一周的工作现在只需几个小时。这一突破展示了AI在辅助机器学习工程方面的潜力,NEO的表现也代表了AI在解决复杂数据挑战方面的巨大进步。来源:微信公众号【机器之心】

LeCun团队实现基于预训练视觉特征的世界模型

Yann LeCun团队近日发布了一项突破性研究成果,展示了一种名为DINO-WM的世界模型,该模型能够基于预训练的视觉特征实现零样本规划。这一成果标志着在构建能够理解并预测物理世界动态的AI系统方面迈出了重要一步。DINO-WM不依赖专家演示、奖励建模或预先学习的逆向模型,而是利用预训练的视觉嵌入和动作预测未来嵌入,从而实现高质量的预测控制和推理时间优化。在多个环境套件中的实验表明,DINO-WM在视觉规划方面的表现优于现有的世界模型,尤其是在需要精确控制和空间理解的复杂环境中。这一成果不仅展示了预训练视觉表征在世界建模中的重要性,也证明了DINO-WM在新环境配置中的泛化能力。来源:微信公众号【机器之心】

Kimi新模型k0-math发布:数学能力超越o1系列

在Kimi全面开放一周年之际,创始人杨植麟发布了新模型k0-math,该模型在数学能力上对标OpenAI的o1系列,并在MATH、中考、高考、考研四个数学基准测试中超越了o1-mini和o1-preview。k0-math的特点是深入思考,即使在解决简单问题时也会进行反复思考和验证。杨植麟表示,k0-math及更强的Kimi探索版将在未来几周内陆续上线Kimi网页版和Kimi智能助手APP。k0-math的发布反映了月之暗面科技有限公司提升模型深入思考能力的重点,同时也展示了公司基于强化学习的Scaling Law的研究成果。Kimi探索版通过强化学习技术,提升了意图增强、信源分析和链式思考三大推理能力,为用户提供更精准的搜索体验。来源:微信公众号【量子位】

【今日案例】

今年的珠海航展与往年有哪些不同,为什么?

https://yuanbao.tencent.com/bot/app/share/chat/3a0dfc6a00f2937635024709857734c8