Ring-2.6-1T : 蚂蚁百灵推出的万亿深度推理模型

AI智库导航-aiguide.cc为您提供最新的AI新闻资讯和最新的AI工具推荐,在这里你可以获得用于营销的AI聊天机器人、AI在商业管理中的应用、用于数据分析的AI工具、机器学习模型、面向企业的AI解决方案、AI在商业客户服务中的应用、AI和自动化工具等。

主要介绍

Ring-2.6-1T 是蚂蚁集团旗下百灵大模型团队(inclusionAI)于 2026 年 5 月 9 日正式发布的万亿级旗舰思考模型,专为复杂真实任务场景设计。该模型的核心突破在于引入了可调节的 Reasoning Effort(推理强度)机制,支持 High 与 XHigh 两档推理模式:High 模式面向高频 Agent 协作、多轮交互和任务拆解场景,以极低 Token 开销实现快速多步执行;XHigh 模式则面向数学竞赛、复杂代码生成、前沿科研分析等极端挑战,提供充分的思维链展开空间。在权威基准测试中,Ring-2.6-1T(High)在 PinchBench 评测中得分 87.60,显著超越 GPT-5.4 xHigh、Gemini-3.1-Pro high 与 Claude-Opus-4.7 xhigh;在高难推理任务上,ARC-AGI-V2 得分 77.78,与 Gemini-3.1-Pro high 和 Claude-Opus-4.7 xhigh 处于同一水位。XHigh 模式下,AIME 2026 数学竞赛得分 95.83,GPQA Diamond 博士级科学问答得分 88.27,推理能力跻身全球头部梯队。该模型已在 OpenRouter 上线并开放限时一周免费体验,近期将正式开源,有望填补开源社区在万亿级可调节推理强度模型领域的空白。

功能特点

- 可调节 Reasoning Effort 双模式:High 模式适配高频 Agent 工作流,Token 开销低、执行速度快,适合生产环境默认调用;XHigh 模式面向高难度推理,充分展开思维链,确保极致准确率。

- 万亿参数深度推理能力:在 XHigh 模式下 AIME 2026 达 95.83、GPQA Diamond 达 88.27,数学与科学推理能力对标甚至超越多款顶尖闭源模型。

- Agent 执行能力 SOTA:在 PinchBench(87.60)、ClawEval(63.82)、Tau2-Bench Telecom(95.32)等真实任务执行基准上表现突出,多工具协作、多步骤任务拆解稳定可靠。

- 高效”快思考”机制:High 模式以极低 Token 消耗直达结果,避免了传统深度推理模型在简单任务上的”过度思考”问题,实现推理能力与资源消耗的解耦。

- 主流 Agent 框架高度兼容:与 Claude Code、Kilo Code、Qwen Code、Hermes Agent、OpenClaw 等主流框架保持兼容,适用于多工具、多步骤、多约束的复杂业务场景。

- 即将正式开源:官方确认近期开源完整模型权重、训练框架及部署工具链,开发者可在消费级硬件上实现高效微调与本地部署。

- OpenRouter 限时免费体验:发布即提供一周免费 API 调用,开发者可零成本验证双模式差异和业务适配性。

优缺点

优点:

- 推理强度可调节,企业可根据任务难度和成本预算灵活选择,真正实现”每一分算力花在刀刃上”。

- High 模式在 Agent 执行类任务中超越 GPT-5.4 xHigh 等顶级闭源模型,同时 Token 开销大幅降低,智效比极高。

- XHigh 模式在数学竞赛和博士级科学问答中达到 95+/88+ 的顶尖水准,覆盖从日常办公到前沿科研的全谱系需求。

- 开源策略+消费级硬件可部署,大幅降低万亿级模型的技术门槛,有利于生态建设和垂直行业适配。

- 双模式设计解决了行业普遍痛点:简单问题不必为”深思”付费,复杂问题不必因算力限制而回答粗糙。

缺点:

- 当前仅通过 API 和 OpenRouter 访问,正式开源时间虽已确认但具体日期尚未公布,本地部署用户需等待。

- 万亿参数规模下,即使 High 模式也需要较强的 GPU 资源(建议多卡 A100/H100 级别),个人开发者本地运行门槛仍较高。

- 双模式切换依赖用户手动选择,缺乏自动感知任务难度并自适应切换的智能路由机制(当前版本未提及)。

- 作为蚂蚁集团闭源技术体系的一部分,与百灵系列其他模型(Ling、Ming)的协同接口和联合调优文档尚不完善。

- 极长上下文(如超过 256K)场景下的性能表现尚未在公开评测中充分验证。

如何使用

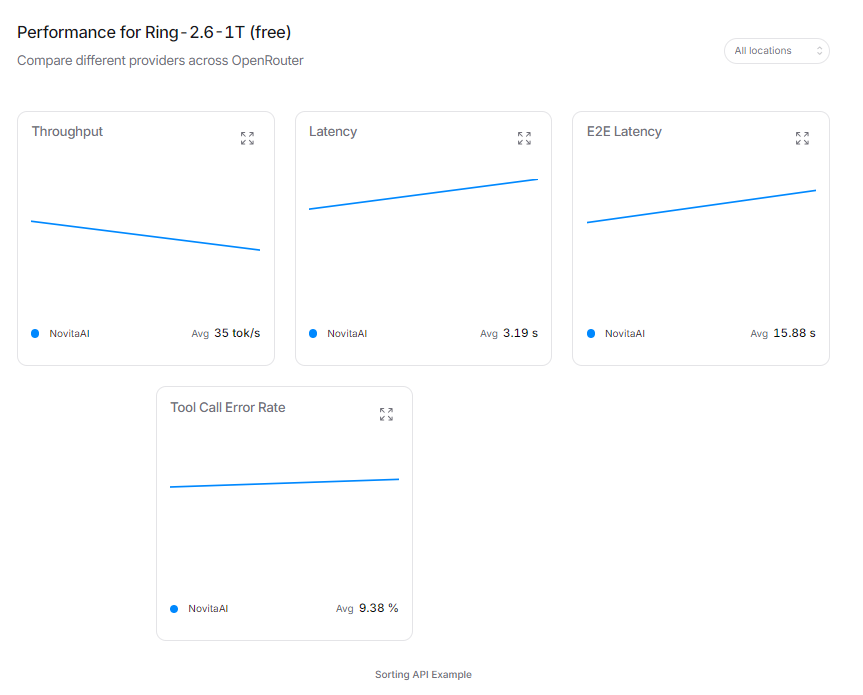

- OpenRouter 免费体验:访问 https://openrouter.ai/inclusionai/ring-2.6-1t:free ,使用 OpenRouter 账号即可直接调用,免费期一周,支持通过 Playground 对话或 API 接入。

- 百灵官方平台:登录蚂蚁百灵官方模型平台(通过百灵大模型官网获取入口),创建应用获取 API Key,在控制台选择 Ring-2.6-1T 模型并指定 reasoning_effort 参数(high 或 xhigh)。

- 选择推理模式:

- 日常办公自动化、客服对话、数据分析等场景 → 选择 High 模式,速度快、成本低。

- 数学证明、科研文献分析、复杂代码调试等场景 → 选择 XHigh 模式,推理更深、准确率更高。

- 接入 Agent 框架:若使用 Claude Code、Kilo Code、Hermes Agent 等框架,在配置文件中将 model 指向 Ring-2.6-1T 的 API 端点,框架会自动兼容其工具调用和多步执行能力。

- 等待正式开源后本地部署:开源后可从 HuggingFace 或 ModelScope 下载权重,使用百灵团队提供的部署工具链在本地 GPU 集群上运行,支持 vLLM、SGLang 等主流推理框架。

框架技术原理

Ring-2.6-1T 的技术核心围绕”可调节推理深度”和”高效快思考”两大方向构建:

1. 可调节 Reasoning Effort 机制

- 模型内部设计了两条推理路径:High 模式采用压缩式思维链,通过训练阶段的策略蒸馏将多步推理知识浓缩为更短的推理轨迹,在保持准确率的同时大幅减少 Token 消耗;XHigh 模式则启用完整深度推理路径,允许模型进行充分的多步思维链展开和自我验证。

- 推理强度通过 API 参数控制,底层通过动态调整生成过程中的思考步数上限和验证轮次实现模式切换。

2. 高效”快思考”架构(参考同团队 Ling-2.6-1T 技术路线)

- 采用 MLA(Multi-head Latent Attention)与 LinearAttention 混合架构,在保持万亿参数表达能力的同时,通过线性注意力机制降低推理阶段的计算复杂度。

- 引入抑制”过程冗余”的强化奖励策略:在 RL 训练阶段,对冗长但无信息增量的推理步骤施加负奖励,鼓励模型以更短的推理路径达到正确答案,从根本上解决”过度思考”问题。

3. 大规模强化学习训练

- 基于百灵团队成熟的 RL 训练管线(参考文心 5.1 的分离式全异步 RL 架构),采用多阶段训练策略:统一 SFT 初始化 → 并行专家训练(分别优化 High/XHigh 能力)→ 在线策略蒸馏融合 → 通用在线 RL 提升开放式能力。

- 训练数据覆盖 Agent 协作、代码生成、数学推理、工具调用等多领域,确保双模式在各自擅长的场景中均达到 SOTA。

4. 万亿参数 MoE 稀疏激活

- 继承百灵系列的 MoE 架构,通过 Top-k 路由动态激活部分专家,在万亿总参数下保持可控的推理计算量,配合 MLA 进一步压缩 KV Cache 占用。

创新点

- 业界首创”推理强度可调节”的万亿级模型:不同于所有竞品要么全力深度推理、要么快速浅层回答的二元设计,Ring-2.6-1T 首次在万亿参数级别实现了用户可控的推理深度切换,开创了”按需思考”的新范式。

- 推理能力与资源消耗解耦:High 模式以约 1/10 的 Token 消耗(参考同团队 Ling-2.6-flash 的 15M tokens vs 竞品 110M+ tokens)实现能力对齐,企业可为不同任务精度匹配不同成本档位。

- “快思考”机制在万亿模型上的首次验证:通过 MLA+LinearAttention 混合架构和过程冗余抑制策略,证明了万亿参数模型不必依赖冗长思维链也能达到顶尖水平,打破了”参数越大越需要慢思考”的行业共识。

- Agent 执行能力超越顶级闭源模型:在 PinchBench 上 87.60 分超越 GPT-5.4 xHigh,证明了在真实多步任务执行场景中,合理的推理策略比单纯堆参数更有效。

- 开源+免费体验的激进生态策略:发布即开源、即免费,旨在快速建立开发者社区和行业标准,与百灵系列 Ling/Ming/Ring 产品矩阵形成完整覆盖。

评估标准

| 评估维度 | 基准/榜单 | Ring-2.6-1T 成绩 | 对比竞品 |

|---|---|---|---|

| 真实任务执行 | PinchBench | 87.60(High) | 超越 GPT-5.4 xHigh、Gemini-3.1-Pro high、Claude-Opus-4.7 xhigh |

| 复杂业务执行 | ClawEval | 63.82 | 开源 SOTA |

| 电信 Agent 任务 | Tau2-Bench Telecom | 95.32 | 超越激活参数更大的模型 |

| 通用推理能力 | ARC-AGI-V2 | 77.78(XHigh) | 与 Gemini-3.1-Pro high、Claude-Opus-4.7 xhigh 同一水位 |

| 数学竞赛 | AIME 2026 | 95.83(XHigh) | 顶尖水平 |

| 博士级科学问答 | GPQA Diamond | 88.27(XHigh) | 顶尖水平 |

| Token 效率 | Artificial Analysis 评测 | 16M tokens 完成全流程 | 较同类产品降低约 75% 输出成本 |

| 综合智能 | Artificial Analysis Intelligence vs. Output Tokens | 落在”最具吸引力象限” | 同参数量级第一梯队 |

应用领域

- 企业级 Agent 自动化:高频多轮交互场景(智能客服、工单处理、审批流自动化),High 模式以低成本实现稳定执行。

- 复杂科研与数学分析:论文推理、公式推导、实验设计验证,XHigh 模式提供充分思考空间确保准确率。

- 代码工程全流程:从代码生成、缺陷定位到修复部署的完整链路,已在内部智能运维系统中处理百万级日志并自动生成修复方案。

- 金融与数据分析:复杂报表生成、多源数据整合、风险评估推理,兼顾速度与深度。

- 教育与内容创作:个性化教学辅导(简单题快速回答、难题深度讲解)、专业文案与剧本创作。

- 多工具协同工作流:与主流 Agent 框架结合,实现跨 API 调用、多步骤任务规划、约束条件下的精准执行。

项目地址

- OpenRouter 免费体验:https://openrouter.ai/inclusionai/ring-2.6-1t:free

- HuggingFace(开源后):https://huggingface.co/inclusionAI/Ring-2.6-1T

- ModelScope(开源后):https://www.modelscope.cn/models/inclusionAI/Ring-2.6-1T

- GitCode 镜像:https://gitcode.com/hf_mirrors/inclusionAI/Ring-1T(Ring-1T 早期版本,Ring-2.6-1T 开源后将更新)

- 百灵官方平台:通过蚂蚁百灵大模型官网获取 API 接入文档和控制台入口

- 同系列参考模型 Ling-2.6-1T 开源地址:https://huggingface.co/inclusionAI/Ling-2.6-1T

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...