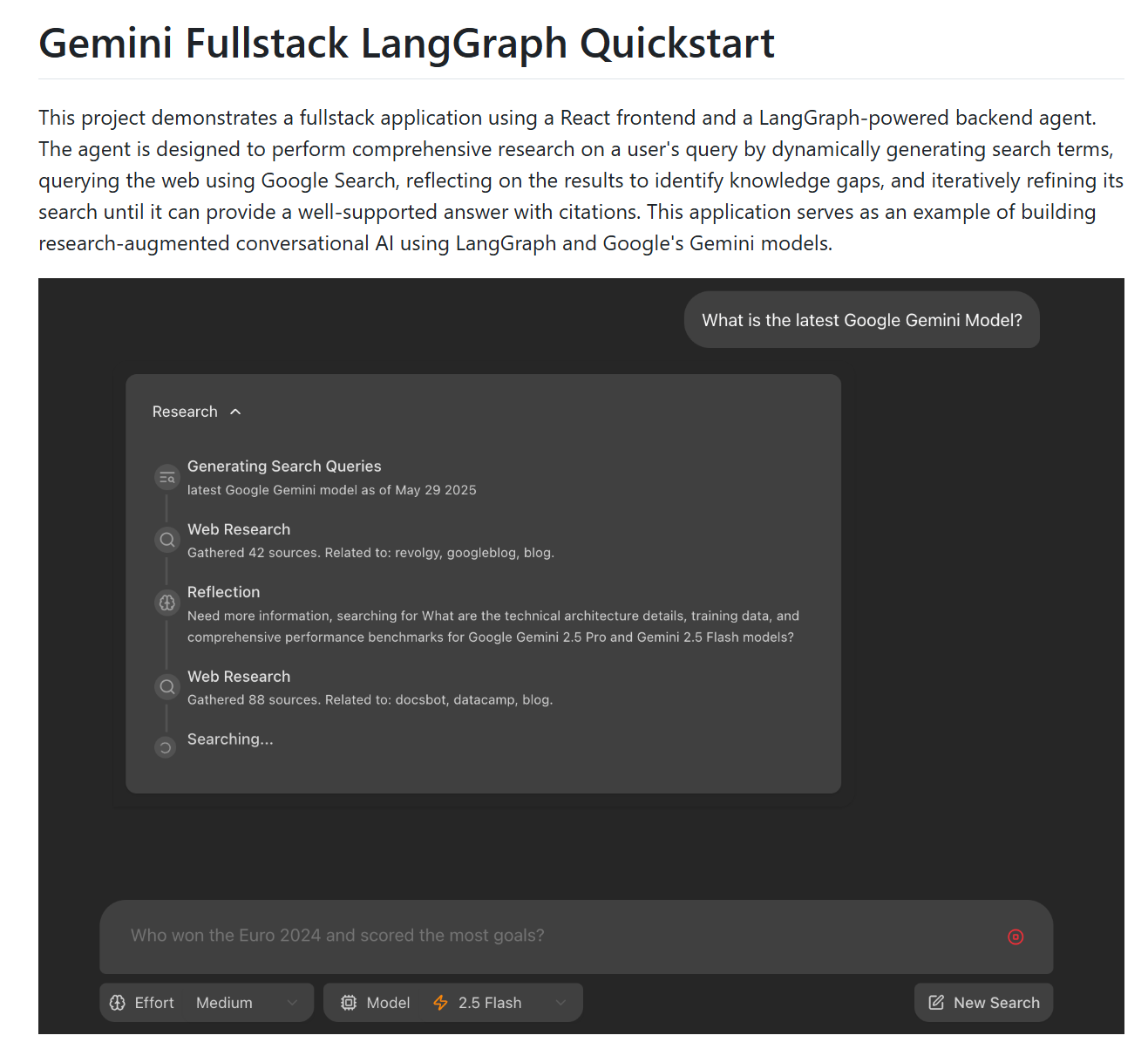

Gemini Fullstack LangGraph Quickstart 是谷歌 DeepMind 开源的全栈 AI 研究助手项目,结合了 Gemini 2.5 模型 和 LangGraph 框架,旨在帮助用户快速构建研究增强的对话式 AI。它通过动态生成搜索查询、利用 Google Search API 获取信息、分析搜索结果中的知识空白,并迭代优化搜索策略,最终提供有充分引用支持的答案。该项目适用于学术研究、知识问答、智能客服等场景,为开发者提供了一个快速启动的模板。

功能特点

- 动态查询生成

- 基于用户输入,使用 Gemini 模型生成初始搜索查询,确保信息收集的全面性。

- 网络研究与知识空白分析

- 通过 Google Search API 获取相关网页信息,并分析搜索结果,识别信息是否充分或存在知识空白。

- 迭代优化

- 如果有知识空白,系统会生成后续查询,并重复搜索和分析步骤,直至信息充分。

- 答案带引用

- 生成的答案包含来自网络来源的引用,确保信息的准确性和可追溯性。

- 全栈实现

- 前端使用 React 和 Vite,后端使用 LangGraph 和 FastAPI,支持快速开发和部署。

- 支持不同搜索强度

- 可调节搜索的广度和深度,满足不同用户的需求。

优缺点分析

优点:

- 高效研究:通过动态查询和迭代优化,显著提升研究效率。

- 信息准确:答案包含引用,确保信息的可靠性。

- 灵活定制:支持自定义搜索策略和答案生成格式。

- 开源免费:项目在 Apache License 2.0 下发布,可自由使用和修改。

缺点:

- 依赖 Google API:需要 Google Search API 密钥,可能受限于 API 的可用性和配额。

- 学习成本:需熟悉 React、LangGraph 等技术栈,对新手有一定门槛。

- 资源需求:运行项目需要一定的计算资源,尤其是处理大规模搜索时。

主要应用场景

- 学术研究助手

- 用于生成研究论文的初步资料收集和分析。

- 知识问答系统

- 在线教育平台中的问答系统,提供详细的答案及引用。

- 智能客服

- 对客户查询提供深入的分析和解答,增强客户服务质量。

- 个人助理

- 为用户提供个性化的研究服务,如市场分析、健康咨询等。

使用方法

- 环境准备

- 安装 Node.js 和 npm(或 yarn/pnpm)、Python 3.8 或更高版本。

- 准备 Google Gemini API 密钥。

- 克隆项目

- 从 GitHub 克隆项目仓库:git clone https://github.com/google-gemini/gemini-fullstack-langgraph-quickstart.git cd gemini-fullstack-langgraph-quickstart

- 安装依赖

- 分别安装前端和后端的依赖:# 前端依赖 cd frontend npm install # 后端依赖 cd ../backend pip install -r requirements.txt

- 配置环境变量

- 复制

.env.example为.env,并填写 Google Gemini API 密钥。

- 复制

- 启动开发服务器

- 使用

make dev命令启动前后端开发服务器。

- 使用

- 访问应用

- 在浏览器中访问

http://localhost:3000,开始使用 Gemini Fullstack LangGraph Quickstart。

- 在浏览器中访问

收费标准

- 开源免费:项目本身是开源的,用户可以免费使用和修改代码。

- API 成本:使用 Google Search API 可能需要支付 API 调用费用,具体费用取决于使用量。

项目地址

- GitHub 仓库:

https://github.com/google-gemini/gemini-fullstack-langgraph-quickstart

AI工具和资源推荐-AI全网资源导航-aiguide.cc

相关导航

暂无评论...